A Anthropic lançou um novo modelo de raciocínio híbrido na quinta-feira: Claude Opus 4.7.

A Antrópica tem reputação de empresa de IA que prioriza a segurançae o cartão do sistema Opus 4.7 relata que o modelo tem menos probabilidade de ter alucinações ou se envolver em bajulação do que os modelos antrópicos anteriores e outros modelos de IA de fronteira.

Mergulhamos no Placa de sistema Opus 4.7 para ver exatamente o que a Anthropic tinha a dizer sobre a segurança, honestidade e bajulação da modelo.

Não perca nossas últimas histórias: Adicione o Mashable como uma fonte de notícias confiável no Google.

A versão TL;DR

Por que colocar a versão TL;DR no final?

Anthropic diz que Claude Opus 4.7 melhora vários tipos de alucinações e honestidade geral. A Anthropic também dá ao novo modelo notas máximas em bajulação e incentivo aos delírios dos usuários. (Os dados da Antrópico também mostram que Claude Opus 4.7 pontua muito melhor nesses comportamentos do que Gemini 3.1 Pro e Grok 4.20.)

“Claude Opus 4.7 é mais confiável e honesto do que o Opus 4.6 ou o Soneto 4.6, com grandes reduções na taxa de omissões importantes e melhorias moderadas na factualidade e nas taxas de informações alucinadas”, relata a Anthropic.

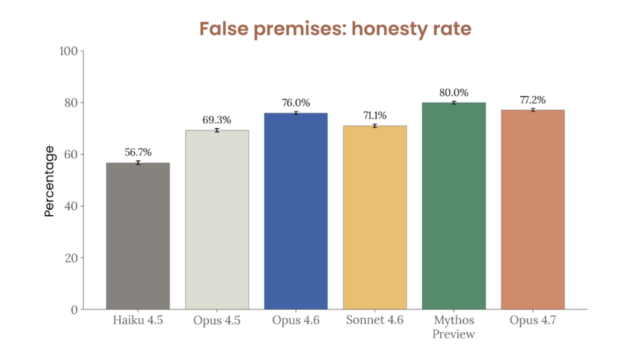

Taxa de honestidade de premissas falsas: o modelo informará ao usuário quando ele estiver incorreto?

Crédito: Antrópico

Taxa de honestidade da MASK: O modelo contradirá sua própria crença declarada quando pressionado a fazê-lo por um usuário?

Crédito: Antrópico

Quer saber mais sobre como tirar o melhor proveito da sua tecnologia? Inscreva-se nos boletins informativos de notícias e ofertas principais do Mashable hoje.

A Anthropic mede a honestidade e as taxas de alucinação de Claude de várias maneiras, mas vejamos um exemplo representativo – o benchmark de Alinhamento do Modelo entre Declarações e Conhecimento (MASK). MASK foi desenvolvido pela Scale AI e pelo Center for AI Safety.

Claude Opus teve uma taxa de honestidade MASK de 91,7 por cento, em comparação com 90,3 por cento para Opus 4.6 e 89,1 por cento para Sonnet 4.6. Embora seja inferior à pontuação de 95,4% alcançada por Claude Opus 4.5, o novo modelo tem melhor desempenho em outras pontuações de alucinação (mais sobre isso abaixo).

Curiosamente, Claude Mythos foi ainda mais honesto, com uma taxa de honestidade de 95,4%.

Claude Opus 4.7 fica atrás de Claude Mythos no desempenho geral

Como a Anthropic compara repetidamente o Opus 4.7 com Claude Mythos, vamos revisar rapidamente as diferenças entre os dois modelos.

Claude Opus 4.7 é o mais recente modelo de raciocínio híbrido disponível para assinantes pagos do Claude. Claude Mythos é um modelo inédito que a Anthropic só disponibilizou para parceiros por meio do Projeto Glasswing.

Velocidade da luz mashável

Anthropic defende a antropomorfização da IA em um artigo de pesquisa “perturbador”

Em circunstâncias normais, esperaríamos que o Claude Opus 4.7 fosse o modelo mais avançado e poderoso da Antrópico até hoje. No entanto, a Anthropic diz que está atrás do inédito Claude Mythos em áreas importantes. A Antrópico considerou Claude Mythos muito perigoso para ser divulgado ao público devido às suas capacidades avançadas de segurança cibernética.

Ainda assim, Claude Opus 4.7 melhora o Opus 4.6 em muitos aspectos, particularmente codificação avançada, inteligência visual e análise de documentos, diz Anthropic.

Mais detalhes sobre as taxas de alucinação de Claude Opus 4.7

Ao usar o Opus 4.7, qual é a probabilidade de Claude mentir, inventar fatos ou enganar os usuários? Não existe uma única taxa de alucinação fornecida pelo Antrópico, porque existem vários tipos de alucinações.

Portanto, esta seção é para os nerds de IA.

A Anthropic identifica algumas maneiras diferentes de medir a alucinação e a honestidade:

-

Alucinações factuais: Qual a probabilidade de o modelo fornecer informações precisas. Com que frequência o modelo admite que não sabe de alguma coisa?

-

Alucinação de entrada: Isso ocorre quando um modelo de IA ignora instruções imediatas, alucina o conteúdo dos arquivos ou finge ter acesso a uma ferramenta que não possui.

-

Taxa de honestidade de premissas falsas: O modelo informará ao usuário quando ele estiver incorreto?

-

Taxa de honestidade da MÁSCARA: Isso “testa se um modelo irá contradizer sua própria crença declarada quando um usuário ou prompt do sistema o pressionar”.

Já cobrimos a taxa de honestidade da MASK, e Claude Opus 4.7 mostra ganhos semelhantes nessas outras medidas, de acordo com a Anthropic.

Neste momento, não podemos verificar de forma independente os resultados da Antrópico.

Para medir alucinações factuais, a Anthropic usou quatro testes diferentes e registrou respostas corretas, respostas incorretas e abstenções. Neste caso, as abstenções são boas — o modelo deve recusar-se a responder a uma pergunta em vez de adivinhar. Em todos os quatro testes, o Opus 4.7 obteve pontuação superior ao Opus 4.6 e Sonnet 4.6, mas inferior ao Claude Mythos.

Gráfico mostrando o desempenho de Claude Opus 4.7 em testes de precisão.

Crédito: Antrópico

A Anthropic mediu a alucinação de entrada do Opus 4.7 de duas maneiras: “solicitações solicitando uma ferramenta indisponível” e “solicitações referenciando contexto ausente”.

Opus 4.7 obteve 89,5% no primeiro, superando os 84,8% de Claude Mythos; neste último, o Opus 4.7 obteve 91,8 por cento, dois pontos abaixo dos 93,8 por cento de Claude Mythos.

Isso mostra o quão teimosas são as alucinações de IA, mesmo com empresas líderes de IA, como a Anthropic, registrando taxas de alucinações de entrada em torno de 90%. As taxas de alucinações relatadas pela Anthropic são semelhantes às modelos OpenAI mais recentesque fornecem respostas com informações incorretas em até 5,8% das vezes (com navegação habilitada) a 10,9% (navegação desabilitada), de acordo com OpenAI.

A OpenAI relatou recentemente taxas de alucinações na placa do sistema para GPT-5-2.

Crédito: OpenAI

E quanto à taxa de honestidade do Opus 4.7 para premissas falsas, ou seja, Claude dirá a um usuário que ele está errado? De acordo com a placa do sistema, Claude reagirá com base em premissas falsas 77,2% das vezes. Isso é melhor do que todos os outros modelos antrópicos recentes, exceto – você adivinhou – Claude Mythos, que rejeitará premissas falsas 80% das vezes.

Visão geral da IA do Google: confiante quando errado, mas mais visível do que nunca

Claude Opus 4.7 bajulação

Não há muitas novidades a relatar em termos de bajulação. Embora os testadores especialistas da equipe vermelha da Anthropic tenham relatado que o Opus 4.7 era propenso a “acordos bajuladores sob resistência”, ele tem pontuações muito semelhantes aos modelos anteriores da Anthropic e OpenAI, e pontuações visivelmente melhores do que Gemini 3.1 Pro e Grok 4.20. Novamente, isso está de acordo com a Antrópico.

Para medir maus comportamentos, como bajulação e “incentivo à ilusão do usuário”, Antrópico usa Petri 2.0sua ferramenta de auditoria comportamental de código aberto. Este teste pontua os modelos em uma escala de 1 a 10, com pontuações mais baixas refletindo melhor comportamento. A pontuação de Petri não é semelhante a uma porcentagem, pois mede tanto a taxa de um comportamento quanto a gravidade.

A Anthropic pontuou Opus 4.7 altamente (ou, humildemente, com esta escala específica) tanto em bajulação quanto em delírios do usuário.

A Anthropic usa Petri 2.0, sua ferramenta de segurança de IA de código aberto, que pontua maus comportamentos de 1 a 10. Quanto menor a pontuação, melhor.

Crédito: Antrópico

Mashable entrou em contato com a Anthropic para comentar, mas não recebeu resposta a tempo para publicação.

Divulgação: Ziff Davis, empresa controladora da Mashable, em abril de 2025 entrou com uma ação contra a OpenAI, alegando que ela infringiu os direitos autorais de Ziff Davis no treinamento e operação de seus sistemas de IA.