A agora famosa equipe de desenvolvimento Qwen AI do Alibaba fez isso de novo: há pouco mais de um dia, eles lançaram o Série de modelos médios Qwen3.5 consistindo em quatro novos modelos de linguagem grande (LLMs) com suporte para chamadas de ferramentas de agente, três dos quais estão disponíveis para uso comercial por empresas e desenvolvedores independentes sob a licença padrão de código aberto Apache 2.0:

-

Qwen3.5-35B-A3B

-

Qwen3.5-122B-A10B

-

Qwen3.5-27B

Os desenvolvedores podem baixá-los agora em Abraçando o rosto e ModelScope. Um quarto modelo, Qwen3.5-Flash, parece ser proprietário e está disponível apenas através do API do Alibaba Cloud Model Studiomas ainda oferece uma forte vantagem em custo em comparação com outros modelos no Ocidente (veja a tabela de comparação de preços abaixo).

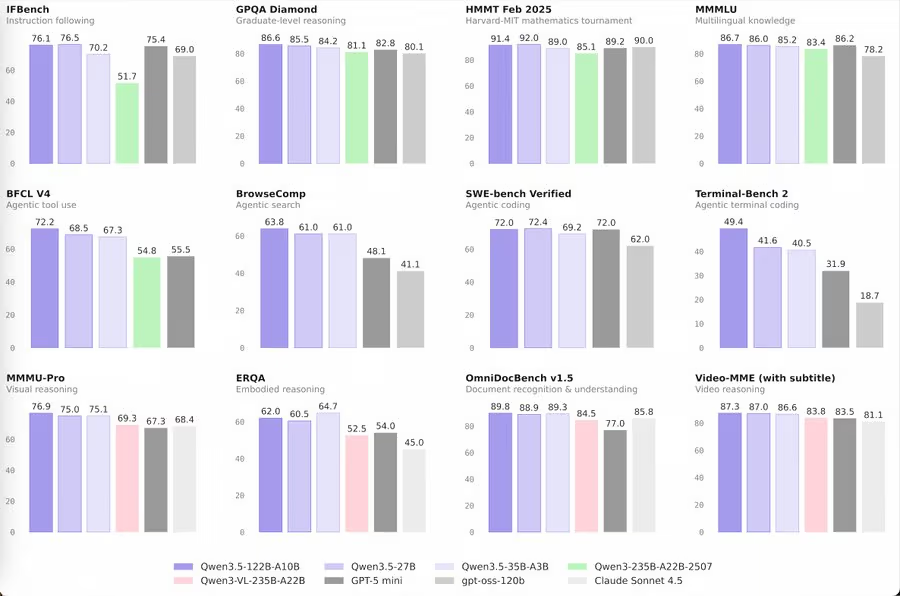

Mas a grande diferença com os modelos de código aberto é que eles oferecem desempenho comparativamente alto em testes de benchmark de terceiros para modelos proprietários de tamanho semelhante de grandes startups dos EUA como OpenAI ou Anthropic, superando o GPT-5-mini da OpenAI e o Claude Sonnet 4.5 da Anthropic – o último modelo que foi lançado há cinco meses.

E a equipe Qwen diz ela projetou esses modelos para permanecerem altamente precisos mesmo quando “quantizados”, um processo que reduz ainda mais seu espaço ao reduzir os números pelos quais as configurações do modelo são armazenadas de muitos valores para muito menos.

Crucialmente, esta versão traz janelas de contexto de “nível de fronteira” para o PC desktop. O carro-chefe Qwen3.5-35B-A3B agora pode exceder 1 milhão de comprimento de contexto de token em GPUs de consumo com 32 GB de VRAM. Embora não seja algo a que todos tenham acesso, é muito menos computacional do que muitas outras opções de desempenho comparável.

Esse salto é possível graças à precisão quase sem perdas sob peso de 4 bits e à quantização de cache KV, permitindo que os desenvolvedores processem conjuntos de dados massivos sem infraestrutura de nível de servidor.

Tecnologia: Força Delta

No centro do desempenho do Qwen 3.5 está uma arquitetura híbrida sofisticada. Embora muitos modelos dependam exclusivamente de blocos transformadores padrão, o Qwen 3.5 integra redes Gated Delta combinadas com um sistema esparso de mistura de especialistas (MoE). As especificações técnicas do Qwen3.5-35B-A3B revelam um design altamente eficiente:

-

Eficiência de parâmetros: Embora o modelo abrigue 35 bilhões de parâmetros no total, ele ativa apenas 3 bilhões para qualquer token fornecido.

-

Diversidade de Especialistas: A camada MoE utiliza 256 especialistas, com 8 especialistas roteados e 1 especialista compartilhado ajudando a manter o desempenho e reduzindo a latência de inferência.

-

Quantização quase sem perdas: a série mantém alta precisão mesmo quando compactada em pesos de 4 bits, reduzindo significativamente o consumo de memória para implantação local.

-

Liberação do modelo básico: Em um movimento para apoiar a comunidade de pesquisa, o Alibaba abriu o código-fonte do Qwen3.5-35B-A3B-Base modelo junto com as versões ajustadas por instrução.

Produto: Inteligência que ‘pensa’ primeiro

Qwen 3.5 introduz um “Modo de Pensamento” nativo como seu estado padrão. Antes de fornecer uma resposta final, o modelo gera uma cadeia de raciocínio interna – delimitada por

-

Qwen3.5-27B: Otimizado para alta eficiência, suportando um comprimento de contexto de mais de 800 mil tokens.

-

Qwen3.5-Flash: A versão hospedada de nível de produção, apresentando um comprimento de contexto de token padrão de 1 milhão e ferramentas oficiais integradas.

-

Qwen3.5-122B-A10B: Projetado para GPUs de nível de servidor (80 GB VRAM), este modelo suporta comprimentos de contexto de mais de 1 milhão, ao mesmo tempo que reduz a lacuna com os maiores modelos de fronteira do mundo.

Os resultados do benchmark validam essa mudança arquitetônica. O modelo 35B-A3B supera notavelmente antecessores muito maiores, como Qwen3-235B, bem como o já mencionado proprietário GPT-5 mini e Sonnet 4.5 em categorias que incluem conhecimento (MMMLU) e raciocínio visual (MMMU-Pro).

Preços e integração de API

Para aqueles que não hospedam seus próprios pesos, o Alibaba Cloud Model Studio oferece uma API competitiva para Qwen3.5-Flash.

-

Entrada: US$ 0,1 por 1 milhão de tokens

-

Saída: US$ 0,4 por 1 milhão de tokens

-

Criação de Cache: US$ 0,125 por 1 milhão de tokens

-

Leitura de cache: US$ 0,01 por 1 milhão de tokens

A API também apresenta um modelo granular de preços de chamadas de ferramentas, com pesquisa na web a US$ 10 por 1.000 chamadas e intérprete de código atualmente oferecido por tempo limitado sem nenhum custo.

Isso torna o Qwen3.5-Flash um dos mais acessíveis para executar API entre todos os principais LLMs do mundo. Veja abaixo uma tabela comparando-os:

|

Modelo |

Entrada |

Saída |

Custo total |

Fonte |

|

Qwen3 Turbo |

US$ 0,05 |

US$ 0,20 |

US$ 0,25 |

|

|

Qwen3.5-Flash |

US$ 0,10 |

US$ 0,40 |

US$ 0,50 |

|

|

deepseek-chat (V3.2-Exp) |

US$ 0,28 |

US$ 0,42 |

US$ 0,70 |

|

|

raciocinador de busca profunda (V3.2-Exp) |

US$ 0,28 |

US$ 0,42 |

US$ 0,70 |

|

|

Grok 4.1 Rápido (raciocínio) |

US$ 0,20 |

US$ 0,50 |

US$ 0,70 |

|

|

Grok 4.1 Rápido (sem raciocínio) |

US$ 0,20 |

US$ 0,50 |

US$ 0,70 |

|

|

MiniMax M2.5 |

US$ 0,15 |

US$ 1,20 |

US$ 1,35 |

|

|

MiniMax M2.5-Relâmpago |

US$ 0,30 |

US$ 2,40 |

US$ 2,70 |

|

|

Pré-visualização em Flash do Gêmeos 3 |

US$ 0,50 |

US$ 3,00 |

US$ 3,50 |

|

|

Kimi-k2.5 |

US$ 0,60 |

US$ 3,00 |

US$ 3,60 |

|

|

GLM-5 |

US$ 1,00 |

US$ 3,20 |

US$ 4,20 |

|

|

ERNIE 5.0 |

US$ 0,85 |

US$ 3,40 |

US$ 4,25 |

|

|

Claude Haiku 4.5 |

US$ 1,00 |

US$ 5,00 |

US$ 6,00 |

|

|

Qwen3-Max (23/01/2026) |

US$ 1,20 |

US$ 6,00 |

US$ 7,20 |

|

|

Gêmeos 3 Pro (≤200K) |

US$ 2,00 |

US$ 12,00 |

US$ 14,00 |

|

|

GPT-5.2 |

US$ 1,75 |

US$ 14,00 |

US$ 15,75 |

|

|

Soneto de Claude 4.5 |

US$ 3,00 |

US$ 15,00 |

US$ 18,00 |

|

|

Gêmeos 3 Pro (>200K) |

US$ 4,00 |

US$ 18,00 |

US$ 22,00 |

|

|

Claude Opus 4.6 |

US$ 5,00 |

US$ 25,00 |

US$ 30,00 |

|

|

GPT-5.2 Pró |

US$ 21,00 |

US$ 168,00 |

US$ 189,00 |

O que isso significa para líderes técnicos empresariais e tomadores de decisão

Com o lançamento dos Modelos Médios Qwen3.5, a iteração rápida e o ajuste fino, antes reservados a laboratórios bem financiados, estão agora acessíveis para desenvolvimento local em muitas empresas não técnicas, dissociando efetivamente a IA sofisticada das enormes despesas de capital.

Em toda a organização, essa arquitetura transforma a forma como os dados são tratados e protegidos. A capacidade de ingerir localmente grandes repositórios de documentos ou vídeos em escala horária permite análises institucionais profundas sem os riscos de privacidade de APIs de terceiros.

Ao executar esses modelos especializados de “mistura de especialistas” dentro de um firewall privado, as organizações podem manter controle soberano sobre seus dados enquanto utilizam modos de “pensamento” nativos e recursos oficiais de chamada de ferramentas para construir agentes autônomos e mais confiáveis.

Os primeiros usuários do Hugging Face elogiaram especificamente a capacidade do modelo de “reduzir a lacuna” em cenários de agência onde anteriormente apenas os maiores modelos fechados podiam competir.

Essa mudança em direção à eficiência arquitetônica em escala bruta garante que a integração da IA permaneça consciente dos custos, segura e ágil o suficiente para acompanhar a evolução das necessidades operacionais.