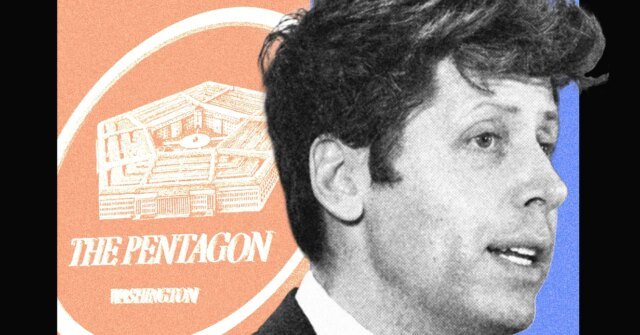

O CEO da OpenAI, Sam Altman, ainda está na berlinda esta semana depois que sua empresa assinou um acordo com os militares dos EUA. Funcionários da OpenAI criticaram a medida, que ocorreu após a implosão do contrato de cerca de US$ 200 milhões da Anthropic com o Pentágono, e pediram a Altman que divulgasse mais informações sobre o acordo. Altman admitiu que parecia “desleixado” nas redes sociais publicar.

Embora este incidente tenha se tornado uma grande notícia, pode ser apenas o exemplo mais recente e público de que a OpenAI cria políticas vagas sobre como os militares dos EUA podem acessar sua IA.

Em 2023, a política de uso da OpenAI proibiu explicitamente o acesso dos militares aos seus modelos de IA. Mas alguns funcionários da OpenAI descobriram que o Pentágono já havia começado a experimentar o Azure OpenAI, uma versão dos modelos da OpenAI oferecidos pela Microsoft, disseram duas fontes familiarizadas com o assunto. Na época, a Microsoft já tinha contratos com o Departamento de Defesa há décadas. Foi também o maior investidor da OpenAI e tinha ampla licença para comercializar a tecnologia da startup.

Naquele mesmo ano, funcionários da OpenAI viram funcionários do Pentágono caminhando pelos escritórios da empresa em São Francisco, disseram as fontes. Eles falaram sob condição de anonimato, pois não têm licença para comentar assuntos de empresas privadas.

Alguns funcionários da OpenAI estavam cautelosos em se associar ao Pentágono, enquanto outros estavam simplesmente confusos sobre o significado das políticas de uso da OpenAI. A política se aplica à Microsoft? Embora fontes tenham dito à WIRED que não estava claro para a maioria dos funcionários na época, porta-vozes da OpenAI e da Microsoft dizem que os produtos Azure OpenAI não estão, e não estavam, sujeitos às políticas da OpenAI.

“A Microsoft tem um produto chamado Azure OpenAI Service que foi disponibilizado ao governo dos EUA em 2023 e está sujeito aos termos de serviço da Microsoft”, disse o porta-voz Frank Shaw em comunicado à WIRED. A Microsoft se recusou a comentar especificamente sobre quando disponibilizou o Azure OpenAI para o Pentágono, mas observa que o serviço não foi aprovado para “ultrassecreto”Cargas de trabalho do governo até 2025.

“A IA já desempenha um papel significativo na segurança nacional e acreditamos que é importante ter um lugar à mesa para ajudar a garantir que seja implementada de forma segura e responsável”, disse a porta-voz da OpenAI, Liz Bourgeois, num comunicado. “Temos sido transparentes com nossos funcionários ao abordarmos esse trabalho, fornecendo atualizações regulares e canais dedicados onde as equipes podem fazer perguntas e interagir diretamente com nossa equipe de segurança nacional.”

O Departamento de Defesa não respondeu ao pedido de comentários da WIRED.

Em janeiro de 2024, a OpenAI atualizou suas políticas para remover a proibição geral do uso militar. Vários funcionários da OpenAI descobriram a atualização da política por meio de um artigo no The Intercept, dizem as fontes. Mais tarde, os líderes da empresa abordaram a mudança numa reunião geral, explicando como a empresa agiria com cuidado nesta área no futuro.

Em dezembro de 2024, a OpenAI anunciou uma parceria com a Anduril para desenvolver e implantar sistemas de IA para “missões de segurança nacional”. Antes do anúncio, a OpenAI disse aos funcionários que a parceria tinha um escopo restrito e lidaria apenas com cargas de trabalho não confidenciais, disseram as mesmas fontes. Isso contrastava com um acordo que a Anthropic havia assinado com a Palantir, que veria a IA da Anthropic usada para trabalho militar classificado.

Palantir abordou a OpenAI no outono de 2024 para discutir a participação em seu programa “FedStart”, confirmou um porta-voz da OpenAI à WIRED. A empresa acabou recusando e disse aos funcionários que seria um risco muito alto, disseram à WIRED duas fontes familiarizadas com o assunto. No entanto, o OpenAI agora funciona com o Palantir de outras maneiras.

Na época em que o acordo com a Anduril foi anunciado, algumas dezenas de funcionários da OpenAI aderiram a um canal público do Slack para discutir suas preocupações sobre as parcerias militares da empresa, disseram fontes e confirmou um porta-voz. Alguns acreditavam que os modelos da empresa não eram confiáveis para lidar com as informações do cartão de crédito de um usuário, muito menos para ajudar os americanos no campo de batalha.