As empresas que têm manipulado modelos separados para raciocínio, tarefas multimodais e codificação de agente podem simplificar sua pilha: o novo Small 4 da Mistral reúne todos os três em um único modelo de código aberto, com níveis de raciocínio ajustáveis sob o capô.

O Small 4 entra em um campo lotado de modelos pequenos – incluindo Qwen e Claude Haiku – que estão competindo em custo de inferência e desempenho de benchmark. A proposta de Mistral: resultados mais curtos que se traduzem em menor latência e tokens mais baratos.

Mistral Small 4 atualiza Mistral Small 3.2, lançado em junho de 2025, e está disponível sob uma licença Apache 2.0. “Com o Small 4, os usuários não precisam mais escolher entre um modelo de instrução rápido, um poderoso mecanismo de raciocínio ou um assistente multimodal: um modelo agora oferece todos os três, com esforço de raciocínio configurável e a melhor eficiência da categoria”, disse Mistral em uma postagem no blog.

A empresa disse que apesar de seu tamanho menor – o Mistral Small 4 tem 119 bilhões de parâmetros totais com apenas 6 bilhões de parâmetros ativos por token – o modelo combina as capacidades de todos os modelos do Mistral. Possui as capacidades de raciocínio do Magistral, a compreensão multimodal do Pixtral e o desempenho de codificação agente do Devstral. Ele também possui uma janela de contexto de 256K que, segundo a empresa, funciona bem para conversas e análises longas.

Rob May, cofundador e CEO do mercado de modelos de linguagem pequena Neurometric, disse à VentureBeat que o Mistral Small 4 se destaca por sua flexibilidade arquitetônica. No entanto, junta-se a um número crescente de modelos mais pequenos que, segundo ele, correm o risco de acrescentar mais fragmentação ao mercado.

“Do ponto de vista técnico, sim, pode ser competitivo em relação a outros modelos”, disse May. “O maior problema é que ele precisa superar a confusão do mercado. A Mistral precisa conquistar a atenção para ter a chance de fazer parte desse conjunto de testes primeiro. Só então eles poderão mostrar as capacidades técnicas do modelo.”

Raciocínio sob demanda

Modelos pequenos ainda oferecem boas opções para construtores empresariais que buscam ter a mesma experiência de LLM a um custo menor.

O modelo é construído em uma arquitetura mista de especialistas, assim como outros modelos Mistral. Possui 128 especialistas com quatro ativos em cada token, o que, segundo Mistral, permite escalonamento e especialização eficientes.

Isso permite que o Mistral Small 4 responda mais rapidamente, mesmo a saídas que exigem mais raciocínio. Ele também pode processar e raciocinar sobre textos e imagens, permitindo aos usuários analisar documentos e gráficos.

Mistral disse que o modelo apresenta um novo parâmetro chamado reasoning_effort, que permitiria aos usuários “ajustar dinamicamente o comportamento do modelo”. As empresas seriam capazes de configurar o Small 4 para fornecer respostas rápidas e leves no mesmo estilo do Mistral Small 3.2, ou torná-lo mais prolixo no estilo do Magistral, fornecendo raciocínio passo a passo para tarefas complexas, de acordo com Mistral.

Mistral disse que o Small 4 roda com menos chips do que modelos comparáveis, com uma configuração recomendada de quatro Nvidia HGX H100s ou H200s, ou duas Nvidia DGX B200s.

“O fornecimento de modelos avançados de IA de código aberto requer ampla otimização. Por meio da estreita colaboração com a Nvidia, a inferência foi otimizada para vLLM e SGLang de código aberto, garantindo um serviço eficiente e de alto rendimento em cenários de implantação”, disse Mistral.

Desempenhos de referência

De acordo com os benchmarks do Mistral, o Small 4 tem um desempenho próximo ao nível do Mistral Medium 3.1 e do Mistral Large 3, especialmente no MMLU Pro.

Mistral disse que o desempenho no seguimento de instruções torna o Small 4 adequado para tarefas empresariais de alto volume, como compreensão de documentos.

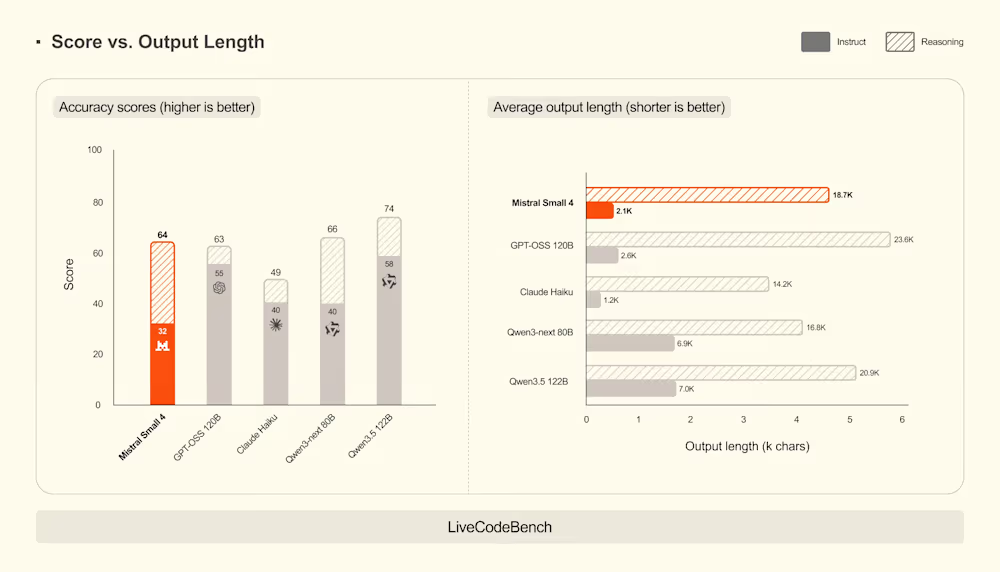

Embora competitivo com outros modelos pequenos de outras empresas, o Small 4 ainda tem desempenho inferior a outros modelos populares de código aberto, especialmente em tarefas de raciocínio intensivo. Qwen 3.5 122B e Qwen 3-next 80B superam Small 4 no LiveCodeBench, assim como Claude Haiku no modo de instrução.

Mistral Small 4 foi capaz de vencer o GPT-OSS 120B da OpenAI no LCR.

Mistral argumenta que o Small 4 atinge essas pontuações com “resultados significativamente mais curtos” que se traduzem em custos de inferência e latência mais baixos do que os outros modelos. Especificamente no modo de instrução, Small 4 produz os resultados mais curtos de qualquer modelo testado – 2,1 mil caracteres versus 14,2 mil para Claude Haiku e 23,6 mil para GPT-OSS 120B. No modo de raciocínio, as saídas são muito mais longas (18,7K), o que é esperado para esse caso de uso.

May disse que embora a escolha do modelo dependa dos objetivos da organização, a latência é um dos três pilares que devem priorizar. “Depende de seus objetivos e do que você está otimizando sua arquitetura para alcançar. As empresas devem priorizar estes três pilares: confiabilidade e resultados estruturados, relação latência/inteligência, ajuste fino e privacidade”, disse May.