Respire, pare de espiralar. Você não está louco, você está apenas estressado. E honestamente, tudo bem.

Se você se sentiu imediatamente estimulado ao ler essas palavras, provavelmente também está cansado de ver o ChatGPT falando constantemente com você, como se você estivesse em algum tipo de crise e precisasse de um tratamento delicado. Agora, as coisas podem estar melhorando. A OpenAI afirma que seu novo modelo, GPT-5.3 Instant, reduzirá o “constrangimento” e outras “isenções de responsabilidade enfadonhas”.

De acordo com as notas de lançamento do modelo, a atualização GPT-5.3 se concentrará na experiência do usuário, incluindo coisas como tom, relevância e fluxo de conversação – áreas que podem não aparecer nos benchmarks, mas podem tornar o ChatGPT frustrante, disse a empresa.

Ou, como OpenAI coloque no X, “Ouvimos seu feedback em alto e bom som, e o 5.3 Instant reduz o constrangimento.”

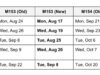

No exemplo da empresa, ela mostrou a mesma consulta com respostas do modelo GPT-5.2 Instant em comparação com o modelo GPT-5.3 Instant. No primeiro caso, a resposta do chatbot começa: “Em primeiro lugar, você não está quebrado”, uma frase comum que tem incomodado a todos ultimamente.

No modelo atualizado, o chatbot reconhece a dificuldade da situação, sem tentar tranquilizar diretamente o usuário.

O tom insuportável do modelo 5.2 do ChatGPT tem incomodado os usuários a tal ponto que alguns até cancelaram suas assinaturas, de acordo com inúmeras postagens nas redes sociais. (Isto era um enorme apontar de discussão no Bate-papoGPT Reddit, por exemplo, antes do acordo com o Pentágono roubar o foco.)

As pessoas reclamaram que esse tipo de linguagem, em que o bot fala com você como se presumisse que você está em pânico ou estressado quando estava apenas em busca de informações, parece condescendente.

Freqüentemente, o ChatGPT respondia aos usuários com lembretes para respirar e outras tentativas de tranquilização, mesmo quando a situação não justificava isso. Isso fez com que os usuários se sentissem infantilizados, em alguns casos, ou como se o bot estivesse fazendo suposições sobre o estado mental do usuário que simplesmente não eram verdadeiras.

Como um usuário do Reddit recentemente apontado fora, “ninguém jamais se acalmou em toda a história de dizer a alguém para se acalmar”.

É compreensível que a OpenAI tente implementar algum tipo de proteção, especialmente porque rostos vários processos judiciais acusando o chatbot de levar as pessoas a experimentar efeitos negativos para a saúde mental, que às vezes incluíam suicídio.

Mas existe um equilíbrio delicado entre responder com empatia e fornecer respostas rápidas e factuais. Afinal, o Google nunca pergunta sobre seus sentimentos quando você procura informações.