Siga ZDNET: Adicione-nos como fonte preferencial no Google.

Principais conclusões da ZDNET

- A Nvidia lançou novos modelos para robôs autônomos, carros e muito mais.

- A Uber adicionará robotáxis com tecnologia Nvidia às cidades já em 2027.

- Robótica mais realista poderia significar personagens robóticos na Disney World.

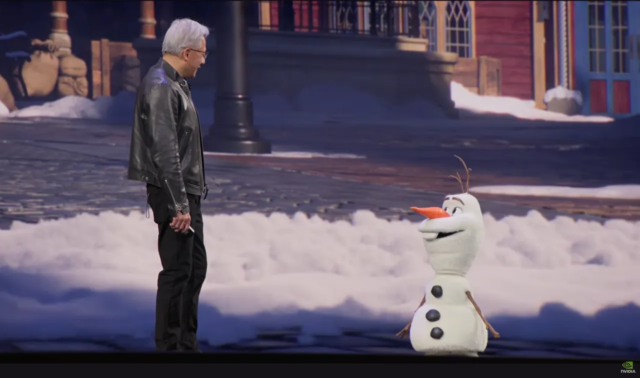

Para encerrar sua palestra Nvidia GTC na segunda-feira, o CEO Jensen Huang trouxe um convidado inesperado: uma versão robô ambulante e falante de Olaf, o boneco de neve animado do filme Frozen da Disney. Huang explicou ao robo-Olaf que ele roda na plataforma Jetson da Nvidia e aprendeu a andar dentro do simulador Omniverse da empresa

As respostas de Olaf nem sempre faziam sentido – a conversa era estranha, mas a ideia era clara: no futuro, personagens robóticos poderiam vagar pela Disneylândia usando a tecnologia da Nvidia.

Além disso: a Nvidia quer possuir seu data center de IA de ponta a ponta

A IA física – sistemas de IA incorporados em máquinas como robôs ou carros que navegam em ambientes do mundo real, em oposição a modelos presos na nuvem ou no seu telefone – vem ganhando força no ano passado e esteve em toda a CES em janeiro passado. Na GTC, a Nvidia fez diversos investimentos em tecnologia, desde novos modelos até suporte para os dados que fazem ou quebram sistemas físicos de IA.

Aqui estão as novidades.

Novos modelos para IA física

A Nvidia lançou vários novos modelos básicos voltados para melhorar o funcionamento de robôs e veículos no mundo real. Eles incluem o Cosmos 3, que gera mundos sintéticos para ajudar a IA física a navegar em ambientes complexos; Isaac GR00T N1.7, um “modelo de ação e linguagem de visão de raciocínio aberto (VLA)” construído para robôs humanóides, que a empresa afirma ser “comercialmente viável para implantação no mundo real”; e Alpamayo 1.5, outro modelo VLA de raciocínio que oferece aos veículos autônomos melhor orientação de navegação e especificações imediatas.

Além disso: Nvidia aposta no OpenClaw, mas adiciona uma camada de segurança – como funciona o NemoClaw

A Nvidia chamou o Alpamayo 1.5 de “uma grande atualização” dentro de sua família existente de modelos de veículos autônomos, observando que “leva vídeo de direção, histórico de movimentos do ego, orientação de navegação e instruções de linguagem natural como entradas”. Ele transforma essas informações em trajetórias de direção que permitem aos desenvolvedores acompanhar de perto o comportamento de um veículo e criar proteções de segurança por meio de avisos. A Nvidia disse que o Alpamayo 1.5 pode ajudar a levar a direção autônoma para o próximo nível, tornando mais fácil aprender com eventos imprevisíveis na estrada, condições climáticas ou atividades de pedestres.

Atualmente, disse a Nvidia, seus clientes estão usando o Cosmos 3 para treinar sistemas físicos de IA e o GR00T N1.7 para “escalar a implantação de robôs humanóides”.

Veículos autônomos

Com a imagem de 110 robôs diferentes atrás dele, o CEO da Nvidia, Jensen Huang, descreveu nosso presente, dizendo que “o momento ChatGPT dos carros autônomos chegou”.

A Nvidia está ampliando sua parceria com o Uber, dizendo que “lançará uma frota de veículos autônomos” movidos inteiramente pelo software Drive AV da Nvidia em 28 cidades em quatro continentes até 2028, com Los Angeles e São Francisco começando no início de 2027. Presumivelmente, isso significa que os usuários poderão reservar carros autônomos no aplicativo Uber em uma escala muito maior.

Além disso: Por que os backups criptografados podem falhar em uma era de ransomware impulsionada por IA

“Esta frota equipada com DRIVE Hyperion aproveitará os modelos abertos NVIDIA Alpamayo e o sistema operacional NVIDIA Halos para acelerar o desenvolvimento e a implantação de serviços de robotáxi seguros e escaláveis em todo o mundo”, disse a empresa no comunicado. liberar.

A empresa também está adicionando várias montadoras, incluindo BYD, Hyundai, Nissan e Geely, à sua iniciativa robotáxi, que já inclui GM, Mercedes e Toyota. Várias dessas novas empresas continuam a usar a plataforma Drive Hyperion da Nvidia, juntamente com seus modelos Alpamayo, para escalar o treinamento de veículos de “nível 4”, ou o mais alto nível de direção automatizada (um carro autônomo totalmente funcional que essencialmente não tem orientação de passageiros humanos).

Edge AI e computação espacial

A Nvidia também está trabalhando com a T-Mobile e a Nokia para acelerar a IA física usando a rede de acesso de rádio AI (AI-RAN) infraestrutura em locais remotos. A empresa diz que isso poderia ajudar a coleta de dados do mundo real para IA física em zonas desconectadas, isoladas ou superlotadas usando (mas sem interromper) a conectividade 5G.

“Ao transformar a rede 5G em um computador de IA distribuído com a T-Mobile e a Nokia, estamos criando um modelo escalável para a infraestrutura de IA de ponta do mundo”, disse Huang no anúncio.

O benefício da IA de ponta é a baixa latência: os hubs locais permitem que as informações se movam mais rapidamente do que quando precisam cruzar toda a Internet. A parceria da Nvidia usa a infraestrutura existente da T-Mobile para apoiar o desenvolvimento de IA física. A empresa disse que as empresas de serviços públicos e de operações já estão usando agentes físicos de IA, sistemas e gêmeos digitais em toda essa infraestrutura para casos de uso como otimizar o tempo de semáforos ou consertar linhas de transmissão.

Em outro anúncioa Nvidia também acenou com a cabeça para a computação espacial. A empresa disse que suas novas plataformas, incluindo Vera Rubin, estão “desbloqueando uma nova era de inovação espacial, trazendo computação de IA para centros de dados orbitais (ODCs), inteligência geoespacial e operações espaciais autônomas”.

Além disso: Qual é o problema com a IA física? Por que a próxima fronteira da tecnologia já está ao seu redor

O que isso significa na prática: a Nvidia está a caminho de aplicativos de IA que podem operar entre a Terra e o espaço, bem como entre o espaço e o espaço. A Nvidia disse que suas plataformas IGX ThorTM e Jetson OrinTM oferecem inferência e processamento de dados com eficiência energética necessários para fazer qualquer coisa em órbita – que é IA de ponta, funcionando como um hub local no espaço, fora da nuvem.

“À medida que implantamos constelações de satélites e exploramos mais profundamente o espaço, a inteligência deve residir onde quer que os dados sejam gerados”, disse Huang no comunicado.

Mas os data centers orbitais ainda são teóricos – não impossíveis, mas ainda não são uma realidade plena. Embora as plataformas IGX Thor e Jetson Orin da Nvidia estejam disponíveis hoje, o componente Vera Rubin Space-1 da iniciativa espacial da empresa, anunciado hoje, estará “disponível em uma data posterior”.

Uma nova ‘fábrica’ de dados físicos de IA

A IA física reside na robótica, nos veículos autônomos e em outras aplicações do mundo real, o que pode significar riscos maiores se algo der errado mecanicamente ou computacionalmente. É melhor evitar esse problema com dados de treinamento de alta qualidade que preparem os sistemas físicos de IA para o maior número possível de situações, garantindo que eles tomem ações mais seguras, mais previsíveis e mais eficazes.

Para acompanhar seu foco em IA física, a Nvidia também anunciou seu Physical AI Data Factory Blueprint, uma “arquitetura de referência aberta que unifica e automatiza como os dados de treinamento são gerados, aumentados e avaliados, reduzindo os custos, o tempo e a complexidade do treinamento de sistemas físicos de IA em escala”.

Além disso: por que comprar Moltbook e OpenClaw pode ser a aposta mais perigosa da Big Tech até agora

Previsto para estar disponível no próximo mês no GitHub, o Blueprint permite que as empresas usem a família Cosmos de modelos de base mundial da Nvidia para processar dados do mundo real e gerar dados sintéticos em escala para treinar sistemas físicos de IA. Ele também oferece suporte a processos de aprendizagem e teste de reforço para veículos autônomos e outros sistemas físicos de IA. De acordo com a Nvidia, o Blueprint garante que os conjuntos de dados sejam diversos, incluindo exemplos sintéticos de casos extremos e outros cenários pouco frequentes que são mais difíceis ou caros de documentar no mundo real.

Embora não esteja amplamente disponível até abril, a Nvidia disse que o Uber já está usando o Blueprint para desenvolver veículos autônomos, e a Skild AI o está usando para robótica de uso geral.

O quadro geral

Os avanços na IA física têm aplicações para o consumidor, como os carros Waymo e os robôs domésticos virais que você provavelmente já encontrou, mas são mais imediatamente relevantes para a engenharia industrial. Robôs mais capazes e autónomos terão o maior impacto nas nossas paisagens públicas e industriais: nas estradas, nas fábricas e, evidentemente, ao caminhar pelos parques temáticos.