Treinar modelos padrão de IA contra um conjunto diversificado de oponentes – em vez de construir regras complexas de coordenação codificadas – é suficiente para produzir sistemas multiagentes cooperativos que se adaptam uns aos outros dinamicamente. Essa é a conclusão da equipe Paradigms of Intelligence do Google, que argumenta que a abordagem oferece uma modelo escalável e computacionalmente eficiente para implantações empresariais multiagentes sem a necessidade de estrutura especializada.

A técnica funciona treinando um agente LLM por meio de aprendizado de reforço descentralizado contra um grupo misto de oponentes – alguns aprendendo ativamente, outros estáticos e baseados em regras. Em vez de regras codificadas, o agente usa aprendizagem contextual para ler cada interação e adaptar seu comportamento em tempo real.

Por que os sistemas multiagentes continuam lutando entre si

O panorama da IA está a mudar rapidamente de sistemas isolados para uma frota de agentes que devem negociar, colaborar e operar simultaneamente em espaços partilhados. Em sistemas multiagentes, o sucesso de uma tarefa depende das interações e comportamentos de múltiplas entidades, em oposição a um único agente.

A fricção central nestes sistemas multiagentes é que as suas interacções envolvem frequentemente objectivos concorrentes. Como esses agentes autônomos são projetados para maximizar suas próprias métricas específicas, é incrivelmente difícil garantir que eles não prejudiquem uns aos outros ativamente nesses cenários de motivos mistos.

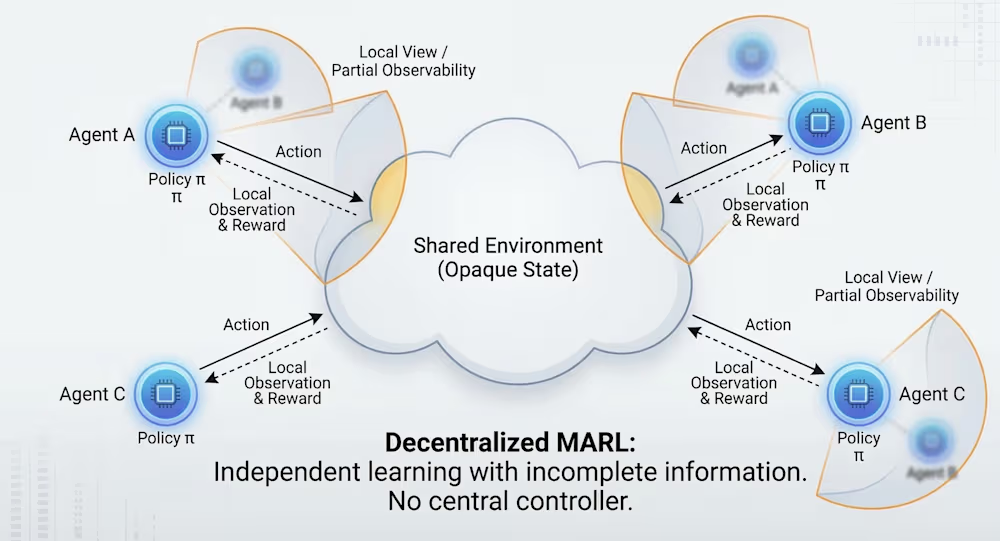

O aprendizado por reforço multiagente (MARL) tenta resolver esse problema treinando vários agentes de IA operando, interagindo e aprendendo no mesmo ambiente compartilhado ao mesmo tempo. No entanto, em arquiteturas empresariais do mundo real, um sistema único e centralizado raramente tem visibilidade ou controla todas as partes móveis. Os desenvolvedores devem confiar no MARL descentralizado, onde os agentes individuais devem descobrir como interagir com outros, tendo acesso apenas aos seus próprios dados e observações locais limitados.

Um dos principais problemas do MARL descentralizado é que os agentes frequentemente ficam presos em estados abaixo do ideal enquanto tentam maximizar suas próprias recompensas específicas. Os pesquisadores referem-se a isso como “deserção mútua”, com base no Dilema do Prisioneiro quebra-cabeça usado na teoria dos jogos. Por exemplo, pense em dois algoritmos de precificação automatizados travados em uma corrida destrutiva até o fundo do poço. Como cada agente otimiza estritamente para sua própria recompensa egoísta, eles chegam a um impasse onde a empresa mais ampla perde.

Outro problema é que as estruturas de treino tradicionais são concebidas para ambientes estacionários, o que significa que as regras do jogo e o comportamento do ambiente são relativamente fixos. Num sistema multiagente, na perspectiva de qualquer agente único, o ambiente é fundamentalmente imprevisível e em constante mudança porque os outros agentes estão simultaneamente a aprender e a adaptar as suas próprias políticas.

Embora os desenvolvedores corporativos atualmente dependam de estruturas que usam máquinas de estado rígidas, esses métodos muitas vezes atingem um obstáculo de escalabilidade em implantações complexas.

“A principal limitação da orquestração codificada é a falta de flexibilidade”, disse Alexander Meulemans, coautor do artigo e cientista pesquisador sênior da equipe de Paradigmas de Inteligência do Google, ao VentureBeat. “Embora as máquinas de estado rígidas funcionem adequadamente em domínios estreitos, elas podem não conseguir escalar à medida que o escopo e a complexidade das implantações de agentes aumentam. Nossa abordagem contextual complementa essas estruturas existentes, promovendo comportamentos sociais adaptativos que estão profundamente enraizados durante a fase pós-treinamento.”

O que isso significa para desenvolvedores que usam LangGraph, CrewAI ou AutoGen

Estruturas como LangGraph exigem que os desenvolvedores definam explicitamente agentes, transições de estado e lógica de roteamento como um gráfico. LangChain descreve esta abordagem como equivalente a uma máquina de estadoonde os nós do agente e suas conexões representam estados e matrizes de transição. A abordagem do Google inverte esse modelo: em vez de codificar como os agentes devem coordenar, produz um comportamento cooperativo através do treinamento, deixando os agentes inferirem regras de coordenação a partir do contexto.

Os pesquisadores provam que os desenvolvedores podem obter sistemas multiagentes avançados e cooperativos usando exatamente as mesmas técnicas padrão de modelagem de sequência e aprendizado por reforço que já alimentam os modelos básicos atuais.

A equipe validou o conceito usando um novo método chamado Predictive Policy Improvement (PPI), embora Meulemans observe que o princípio subjacente é independente do modelo.

“Em vez de treinar um pequeno conjunto de agentes com funções fixas, as equipes deveriam implementar uma rotina de treinamento de ‘grupo misto’”, disse Meulemans. “Os desenvolvedores podem reproduzir essas dinâmicas usando algoritmos de aprendizagem por reforço padrão e prontos para uso (como GRPO).”

Ao expor os agentes à interação com diversos co-jogadores (ou seja, variando nas solicitações do sistema, nos parâmetros ajustados ou nas políticas subjacentes), as equipes criam um ambiente de aprendizagem robusto. Isto produz estratégias que são resilientes ao interagir com novos parceiros e garante que a aprendizagem multiagente conduza a comportamentos cooperativos estáveis e de longo prazo.

Como os pesquisadores provaram que funciona

Para construir agentes que possam deduzir com sucesso a estratégia de um co-jogador, os pesquisadores criaram uma configuração de treinamento descentralizada onde a IA é colocada contra um grupo misto e altamente diversificado de oponentes, composto por modelos de aprendizagem ativa e programas estáticos baseados em regras. Essa diversidade forçada exige que o agente descubra dinamicamente com quem está interagindo e adapte seu comportamento instantaneamente, inteiramente a partir do contexto da interação.

Para desenvolvedores corporativos, a frase “aprendizado em contexto” geralmente gera preocupações sobre o inchaço da janela de contexto, custos de API e latência, especialmente quando as janelas já estão repletas de dados de geração aumentada de recuperação (RAG) e prompts do sistema. No entanto, Meulemans esclarece que esta técnica se concentra na eficiência e não na contagem de tokens. “Nosso método se concentra em otimizar como os agentes utilizam o contexto disponível durante o pós-treinamento, em vez de exigir estritamente janelas de contexto maiores”, disse ele. Ao treinar agentes para analisar seu histórico de interação para inferir estratégias, eles usam o contexto alocado de forma mais adaptativa, sem exigir janelas de contexto mais longas do que as aplicações existentes.

Usando o Dilema do Prisioneiro Iterado (DPI) como referência, os pesquisadores alcançaram uma cooperação robusta e estável sem nenhuma das muletas tradicionais. Não há separações artificiais entre meta-alunos e alunos internos, e não há necessidade de codificar suposições sobre como funciona o algoritmo do oponente. Como o agente está se adaptando em tempo real e, ao mesmo tempo, atualizando os pesos do modelo básico ao longo do tempo em muitas interações, ele ocupa efetivamente as duas funções simultaneamente. Na verdade, os agentes tiveram melhor desempenho quando não receberam informações sobre os seus adversários e foram forçados a adaptar-se ao seu comportamento através de tentativa e erro.

O papel do desenvolvedor muda de escritor de regras para arquiteto

Os pesquisadores dizem que seu trabalho preenche a lacuna entre a aprendizagem por reforço multiagente e os paradigmas de treinamento dos modelos básicos modernos. “Uma vez que os modelos básicos exibem naturalmente aprendizagem no contexto e são treinados em diversas tarefas e comportamentos, nossas descobertas sugerem um caminho escalável e computacionalmente eficiente para o surgimento de comportamentos sociais cooperativos usando técnicas padrão de aprendizagem descentralizada”, escrevem eles.

À medida que confiar na adaptação comportamental no contexto se torna o padrão em vez de regras rígidas de codificação, o elemento humano da engenharia de IA mudará fundamentalmente. “A função do desenvolvedor de aplicativos de IA pode evoluir desde o projeto e gerenciamento de regras de interação individuais até o projeto e fornecimento de supervisão arquitetônica de alto nível para ambientes de treinamento”, disse Meulemans. Essa transição eleva os desenvolvedores da escrita de regras restritas para a assunção de um papel estratégico, definindo os parâmetros amplos que garantem que os agentes aprendam a ser úteis, seguros e colaborativos em qualquer situação.