Siga ZDNET: Adicione-nos como fonte preferencial no Google.

Principais conclusões da ZDNET

- A Nvidia exibiu cinco racks de equipamentos cobrindo todos os aspectos da infraestrutura de IA.

- A Nvidia argumenta que a economia da IA é melhor quando todas as peças são da Nvidia.

- A ambição cada vez maior da Nvidia inclui robótica e até IA no espaço.

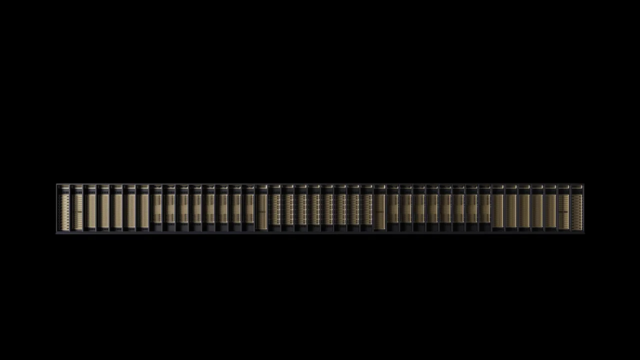

A imagem que a Nvidia sugeriu à mídia para sua conferência GTC em San Jose, Califórnia, esta semana, é uma linha de 40 retângulos representando racks de servidores de data centers de vários tipos. Sem rótulos, apenas as prateleiras parecendo uma estante com as obras completas de Shakespeare ou, o que é mais sinistro, uma falange de soldados.

A mensagem implícita da imponente parede de racks é que a Nvidia, se ainda não o faz, acabará por possuir todo o processamento no data center, de uma ponta à outra.

Além disso: este sistema operacional alimenta silenciosamente toda a IA – e também a maioria dos futuros trabalhos de TI

No palco do show, o CEO da Nvidia, Jensen Huang, usou o discurso de segunda-feira para anunciar uma ampliação das ofertas de chips e sistemas da empresa. As linhas de produtos existentes incluem o chip CPU Vera, o chip GPU Rubin e, agora, um novo tipo de rack de equipamentos se junta a eles, para inferência ultrarrápida, chamado LPX.

Um novo rack apenas para inferência de IA

O rack LPX, que estará disponível ainda este ano, é composto de chips que a Nvidia projetou usando propriedade intelectual licenciada em dezembro da startup de IA Groq por US$ 20 bilhões.

A abordagem Groq transformada, implementada na LPU Nvidia Groq 3, será usada no LPX em combinação com GPUs Rubin para alcançar um equilíbrio ideal entre a velocidade de inferência e a quantidade total de dados que podem ser manipulados.

O Groq 3 LPU “pode combinar os FLOPS extremos [floating-point operations per second] de GPUs e a largura de banda de LPUs em um”, disse Ian Buck, chefe de computação de hiperescala e alto desempenho da Nvidia, em um pré-briefing para a mídia.

Além disso: os ataques na nuvem estão ficando mais rápidos e mortíferos – aqui está o seu melhor plano de defesa

O Groq LPU original, que significa “unidade de processamento de linguagem”, possui 500 megabytes de SRAM no chip, uma forma de memória rápida muito maior do que um cache de memória de chip normal. A SRAM pode conter os pesos – também conhecidos como parâmetros neurais – de grandes modelos de linguagem, bem como o “cache KV”, os resultados intermediários de cálculos que aceleram a inferência.

Ao usar a LPU em um rack junto com as GPUs, a SRAM da LPU pode buscar os dados mais necessários, reduzindo a necessidade de solicitar dados de DRAM fora do chip, o que as GPUs precisam fazer. Esse cache SRAM local reduz drasticamente a latência, o tempo de ida e volta para recuperar e gerar uma resposta a uma consulta, disse Buck.

“As coisas que levaram um dia inteiro de consultas serão produzidas em menos de uma hora”, disse Buck.

Mudando a economia da IA

A LPU também pode realizar o processamento de consultas com muito mais eficiência, afirma a Nvidia. A empresa de pesquisa de mercado TechInsights relatou, com base no silício Groq existente antes do acordo com a Nvidia, que a “energia por bit” da LPU para acesso à memória é um terço de um picojoule, ou 20 vezes menos do que os 6 picojoules de uma GPU para acessar DRAM.

Pela mesma quantia de dinheiro por token, as LPUs Groq no rack LPX fornecerão 35 vezes mais tokens por segundo por megawatt de energia, disse Buck, usando o exemplo de 500.000 tokens processados por segundo por um preço de US$ 45 por milhão de tokens.

Também: Por que você pagará mais pela IA em 2026 e três dicas para economizar dinheiro para experimentar

Essa aceleração drástica na busca e entrega de tokens também leva a um aumento de 10 vezes na receita em dólares que um provedor de IA pode obter por segundo por megawatt, disse Buck.

Embora não seja explicitamente mencionado, a redução do uso de DRAM fora do chip é cada vez mais importante, dado que os preços da DRAM estão subindo neste momento.

Melhor quando você compra tudo de nós

O rack LPX faz parte da proposta geral de Huang para o mundo da IA: que a empresa oferece melhor economia ao vender todas as partes da equação – não apenas os chips Vera, Rubin e LPU, mas também o software que roda em cima deles.

“Desde o bolo de cinco camadas de energia, chips, a própria infraestrutura, os modelos e as aplicações, esta infraestrutura multicamadas está impulsionando a receita e a criação de empregos”, disse Buck da Nvidia aos repórteres.

O LPX fica naquela fileira de 40 retângulos ao lado de outros quatro racks sobre os quais Huang falou, que constituem a proposta de sua empresa para uma infraestrutura completa de IA.

Tem o Vera-Rubin NVL72, um rack composto por 72 CPUs Rubin e 36 CPUs Vera; um novo rack somente para CPU, o rack Vera CPU, composto por 256 CPUs Vera e 400 terabytes de DRAM; um novo tipo de rack de armazenamento de dados, o Bluefield 4 STX, que atua como uma espécie de repositório para o cache KV em todas as GPUs; e a versão mais recente do rack de equipamentos de rede Ethernet da Nvidia, o Spectrum-6 SPX.

Além disso: os modelos físicos de IA da Nvidia abrem caminho para robôs de próxima geração – aqui estão as novidades

Buck explicou que os racks de CPU Veru aceleram todas as tarefas de IA de agência que seriam demais para uma CPU x86 convencional baseada em Intel ou AMD.

“Hoje, as GPUs apelam às CPUs para fazer a chamada de ferramentas, a consulta SQL e a compilação de código”, disse Buck. “Essa execução de sandbox é uma parte crítica do treinamento e da implantação de agentes nos data centers, e essas CPUs precisam ser rápidas”.

Ele disse que o rack de CPU Vera pode ser uma vez e meia mais rápido em tarefas de CPU de thread único em comparação com as CPUs x86 existentes. Como resultado, os racks STX quadruplicarão o desempenho por watt, dobrarão as páginas por segundo para dados corporativos e fornecerão cinco vezes mais tokens por segundo de memória de contexto necessária para fábricas de IA que executam fluxos de trabalho GenTech.

“Os resultados são surpreendentes”, disse Buck.

O novo rack de armazenamento de dados, explicou Buck, é “uma camada compartilhada de alta largura de banda otimizada para armazenar e recuperar os enormes dados de cache de valor-chave gerados por LLMs e fluxos de trabalho GenTech”. Embora o rack seja composto por Nvidia Bluefield DPU (unidades de processamento de dados, companheiras das CPUs), o STX é apenas uma “arquitetura de referência”, disse Buck, o que significa que os racks reais serão projetados e construídos por parceiros da Nvidia.

Ampliando a ambição

A escala e a amplitude da ambição expostas na palestra de Huang são notáveis. Como minha colega Radhika Rajkumar detalha em sua cobertura, Huang também falou sobre sua própria oferta para IA agente, NemoClaw, e múltiplas ofertas para a chamada IA física, principalmente robótica. Huang até falou sobre IA no espaço, embora os detalhes da implantação de servidores baseados em satélite permaneçam vagos, de acordo com Radhika.

Buck caracterizou a parede de diferentes servidores como “um co-design extremo de ponta a ponta, a fim de fornecer o valor máximo da fábrica de IA para todas as cargas de trabalho em IA e em todos os setores”.

Também: Nvidia aposta no OpenClaw, mas adiciona uma camada de segurança – como funciona o NemoClaw

É também uma maneira astuta da Nvidia tornar sua proposta de valor evidente para qualquer um que considere usar CPUs e GPUs da concorrente AMD, ou usar equipamentos exóticos de IA de startups desafiadoras, como a Cerebras Systems. Com um portfólio de cinco racks de equipamentos, abrangendo todas as funções do data center, Huang está dizendo aos clientes que tudo funcionará com mais eficiência e gerará mais receita de IA, quando tudo for fornecido pela Nvidia.

Para Huang, é também o culminar de uma busca de décadas para assumir o controle de partes da computação dos operadores históricos. No passado, ele tentou invadir o mercado de CPU para servidores com CPUs robustas para servidores, como Denver. Mas Huang teve que se retirar quando o poder arraigado da CPU Xeon da Intel tornou-se impossível de superar.

Com uma estante de peças completas coletadas para um data center, a empresa de Huang está preparada para definir a era da computação e sobrecarregar as empresas que definiram a era anterior.