A eletricidade é uma matéria-prima essencial para a inteligência artificial, mas as novas técnicas de processamento superam a capacidade dos operadores de centros de dados de gerir a sua relação com a rede elétrica, forçando-os a reduzir a velocidade em até 30%.

“Há muito poder desperdiçado nessas fábricas de IA”, disse o CEO da Nvidia, Jensen Huang, durante um discurso na conferência anual de clientes GTC da empresa. “Cada watt não utilizado é perda de receita”, proclamou a empresa durante a apresentação anual.

Hoje, inicialização Niv-AI saiu do sigilo com US$ 12 milhões em financiamento inicial para resolver esse problema, medindo com precisão o uso de energia da GPU com novos sensores e desenvolvendo ferramentas para gerenciá-lo de forma mais eficiente.

A startup com sede em Tel Aviv foi fundada no ano passado pelo CEO Tomer Timor e pelo CTO Edward Kizis, e é apoiada pela Glilot Capital, Grove Ventures, Arc VC, Encoded VC, Leap Forward e Aurora Capital Partners. A empresa se recusou a compartilhar sua avaliação.

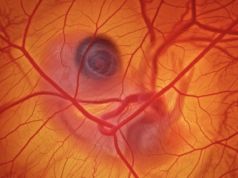

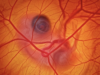

À medida que os laboratórios de fronteira operam milhares de GPUs em conjunto para treinar e executar modelos avançados, há picos frequentes de demanda de energia em escala de milissegundos à medida que os processadores alternam entre tarefas de computação e comunicação com outras GPUs.

Esses picos dificultam que os data centers gerenciem a energia que extraem da rede. Para evitar ficar sem eletricidade suficiente, os data centers pagam pelo armazenamento temporário de energia para cobrir picos de energia ou limitar o uso da GPU. Ambos os casos reduzem o retorno dos investimentos em chips caros.

“Simplesmente não podemos continuar a construir centros de dados da forma como os construímos agora”, disse Lior Handelsman, sócio da Grove Ventures que faz parte do conselho da Niv.

Evento Techcrunch

São Francisco, Califórnia

|

13 a 15 de outubro de 2026

O primeiro passo no roteiro da Niv é entender o que está acontecendo; a empresa agora está implantando sensores em nível de rack que detectam o uso de energia em milissegundos em GPUs de sua propriedade e em conjunto com parceiros de design. O objetivo é compreender os perfis de poder específicos de diferentes tarefas de aprendizagem profunda e desenvolver técnicas de mitigação que permitam aos data centers desbloquear mais da capacidade existente.

Naturalmente, os engenheiros esperam construir um modelo de IA com base nos dados que coletam, com o objetivo de treiná-lo para prever e sincronizar cargas de energia em todo o data center — um “copiloto” para engenheiros de data center.

A Niv-AI espera ter um sistema operacional em alguns data centers dos EUA nos próximos seis a oito meses. É uma ideia atraente, já que os hiperscaladores que tentam construir novos data centers enfrentam dificuldades no uso do solo e na cadeia de suprimentos. Os fundadores veem seu produto final como uma “camada de inteligência” ausente entre os data centers e a rede elétrica.

“A rede tem medo de que o data center consuma muita energia em um horário específico”, disse Timor ao TechCrunch. “O problema que estamos analisando é um problema com os dois lados da corda. Um é tentar ajudar os data centers a utilizar mais GPUs e, esperançosamente, aproveitar mais a energia pela qual já estão pagando. Por outro lado, você também pode criar perfis de energia muito mais responsáveis entre os data centers e a rede.”