Não me traz nenhuma alegria dizer isso, mas o anti-herói inconstante de Patricia Highsmith em O talentoso Sr. Ripley não precisaria mais ser talentoso. Os avanços na IA generativa – a capacidade de criar vídeos confiáveis de qualquer pessoa, clones de voz indistinguíveis e outras falsificações aceitáveis com facilidade – eliminaram todo o talento artístico da fraude.

Uma nova investigação liderada por uma equipa da Escola de Medicina Icahn do Monte Sinai, em Nova Iorque, apresentou um caso preocupante para uma vigilância constante contra a ameaça de provas médicas “deepfake”.

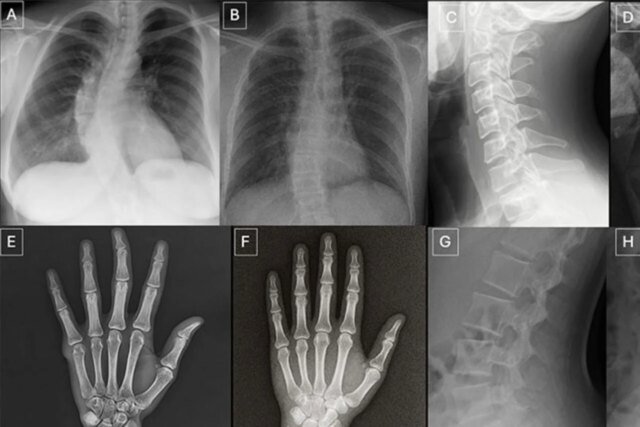

Os investigadores submeteram um grupo de voluntários, 17 radiologistas praticantes de seis países, a testes que exigiam que distinguissem raios X reais de simulacros gerados por IA num conjunto de 264 imagens únicas. Os resultados não inspiraram confiança.

“Nosso estudo demonstra que esses raios X falsos são realistas o suficiente para enganar os radiologistas, os especialistas em imagens médicas mais altamente treinados”, disse o autor principal do estudo, Dr. Mickael Tordjman, médico e pós-doutorado na Escola Icahn, em uma imprensa declaração“mesmo quando sabiam que imagens geradas por IA estavam presentes”.

Em um teste posterior, as falsificações de IA enganaram até mesmo um dos mesmos modelos multimodais de linguagem grande que foram usados para criá-los: o ChatGPT-4o da OpenAI.

O tremor da falsificação

Tordjman levou a cabo este projecto devido a uma preocupação genuína com os riscos para os pacientes, médicos e inúmeros outros espectadores inocentes. Imagens médicas críveis geradas por IA, disse ele, “criam uma vulnerabilidade de alto risco para litígios fraudulentos se, por exemplo, uma fratura fabricada puder ser indistinguível de uma fratura real”. Esta questão já chamou a atenção de especialistas jurídicos que procuram proteger os júris de serem contaminados pela exposição a falsificações semelhantes de IA.

“Há também um risco significativo de segurança cibernética”, acrescentou Tordjman, “se os hackers obtiverem acesso à rede de um hospital e injetarem imagens sintéticas para manipular diagnósticos de pacientes ou causarem caos clínico generalizado”.

Os 17 radiologistas voluntários testados pela equipe de Tordjman foram expostos a dois conjuntos de dados distintos para este estudo, publicado Terça-feira na revista Radiologia. O primeiro pediu aos voluntários que observassem 154 radiografias estáticas, metade radiografias genuínas e metade falsificações geradas pelo Chat GPT-4o (77 cada). O segundo teste utilizou um modelo de difusão especializado AI treinado para fazer radiografias de tórax confiáveis, com órgãos como o coração e os pulmões visíveis, chamado RoentGen; os voluntários foram solicitados a classificar um conjunto de dados de 110 imagens, 55 reais e 55 falsas.

Os radiologistas que foram informados do fato de que esses conjuntos de dados continham imagens de IA se saíram melhor do que aqueles expostos às imagens sem qualquer indicação da finalidade real do teste, mas ainda assim não muito bem. Esses voluntários mostraram uma precisão média de 75%, em comparação com apenas 41% de precisão para o último grupo.

Os 17 radiologistas individuais do estudo, cuja profundidade de experiência profissional variou (zero a 40 anos de trabalho), variaram de 58% a 92% nas imagens geradas pelo ChatGPT e de 62% a 78% nas radiografias de tórax feitas pela RoentGen. A idade e a experiência não pareciam ser um factor na sua precisão, mas, por alguma razão, os radiologistas músculo-esqueléticos provaram ser significativamente melhores na detecção de falsificações do que outros subespecialistas.

Um jogo para os vivos (e para os chatbots)

Tordjman e sua equipe também realizaram testes em quatro LLMs multimodais, ChatGPT-4o e 5, Gemini 2.5 Pro do Google e Llama 4 Maverick da Meta. Os bots tiveram um desempenho um pouco pior do que os humanos, variando de cerca de 57% a 85% de precisão nas falsificações feitas pelo GPT-4o (uma exibição particularmente embaraçosa para o próprio ChatGPT-4o, de certa forma).

Quando se tratava dos raios X de tórax sintéticos da RoentGen, a precisão dos LLMs na detecção de falsificações variava um pouco mais, variando de 52% a 89%.

Tordjman disse que espera que trabalhos futuros se baseiem nessas descobertas para estabelecer conjuntos de dados educacionais e ferramentas de detecção. “Imagens médicas deepfake muitas vezes parecem perfeitas demais”, observou ele. “Os ossos são excessivamente lisos, a coluna vertebral anormalmente reta, os pulmões excessivamente simétricos, os padrões dos vasos sanguíneos excessivamente uniformes e as fraturas parecem excepcionalmente limpas e consistentes.”

Você pode fazer uma versão do teste aqui você mesmo. Mas não se culpe por uma pontuação ruim. Como alguém que sabia muito sobre vigaristas e autoengano uma vez disse: “A vida é uma longa falha de compreensão”.