O mais novo modelo de IA do Google está aqui: Gêmeos 3.1 Flash-Litee as maiores melhorias desta vez estão no custo e na velocidade, especialmente para empresas e desenvolvedores que buscam aproveitar o raciocínio poderoso e os recursos multimodais do gigante de pesquisa e nuvem dos EUA.

Posicionando-o como o modelo mais econômico e responsivo da série Gemini 3, o Google está oferecendo uma solução desenvolvida especificamente para inteligência em escala.

Este lançamento chega poucas semanas após a estreia em fevereiro do seu irmão mais pesado, o Gemini 3.1 Pro, completando uma estratégia em níveis que permite às empresas escalar a inteligência em todas as camadas da sua infraestrutura.

Tecnologia: otimizada para o “tempo até o primeiro token”

No mundo da IA de alto rendimento, a métrica que geralmente determina a experiência do usuário não é apenas a precisão: é a latência. Para suporte ao cliente em tempo real, moderação de conteúdo ao vivo ou geração instantânea de interface de usuário, o “token do tempo até a primeira resposta” é o principal indicador para saber se um aplicativo parece uma ferramenta ou um companheiro de equipe. Se um modelo demorar até dois segundos para iniciar sua resposta, a ilusão de interação fluida será quebrada.

Gemini 3.1 Flash-Lite foi projetado especificamente para essa sensação instantânea. De acordo com benchmarks internos e avaliações de terceiros, o Flash-Lite supera seu antecessor, Gemini 2.5 Flash, com um tempo 2,5X mais rápido para o primeiro token. Além disso, apresenta um aumento de 45% na velocidade geral de saída – 363 tokens por segundo em comparação com 249.

Essa velocidade é alcançada por meio do que Koray Kavukcuoglu, vice-presidente de pesquisa do Google DeepMind, descreve em um post X como uma quantidade inacreditável de engenharia complexa para fazer a IA parecer instantânea.

Talvez a adição técnica mais inovadora seja a introdução de níveis de pensamento.

Padronizado nas variantes Flash-Lite e Pro, esse recurso permite aos desenvolvedores modular dinamicamente a intensidade do raciocínio do modelo. Para uma tarefa de classificação simples ou uma análise de sentimento de alto volume, o modelo pode ser reduzido para obter velocidade máxima e custo mínimo.

Por outro lado, para exploração de código complexo, geração de painéis ou criação de simulações, o pensamento pode ser ajustado, permitindo que o modelo execute raciocínio e lógica mais profundos antes de emitir sua primeira resposta.

Produto: comparando o rebatedor pesado de peso leve

Embora o sufixo “Lite” muitas vezes implique um sacrifício significativo de capacidade, os dados de desempenho sugerem um modelo que se enquadra bem no território de sistemas muito maiores. Gemini 3.1 Flash-Lite alcançou uma pontuação Elo de 1432 na tabela de classificação Arena.ai, colocando-o em um nível competitivo com modelos muito maiores em contagem de parâmetros.

Os principais resultados do benchmark destacam seus pontos fortes especializados em diversos domínios cognitivos:

-

Conhecimento científico: 86,9 por cento no GPQA Diamond.

-

Compreensão multimodal: 76,8 por cento no MMMU-Pro.

-

Perguntas e respostas multilíngues: 88,9 por cento no MMMLU.

-

Conhecimento paramétrico: 43,3 por cento no SimpleQA verificado.

-

Raciocínio abstrato: 16,0 por cento no Último Exame da Humanidade (conjunto completo)

O modelo é particularmente adequado à conformidade de saída estruturada – um requisito crítico para desenvolvedores corporativos que precisam de IA para gerar código JSON, SQL ou UI válido que não interrompa os sistemas downstream.

Em benchmarks como LiveCodeBench, o Flash-Lite obteve 72,0%, superando vários rivais em sua classe de peso, incluindo o GPT-5 mini, que obteve 80,4% em um subconjunto diferente, mas ficou significativamente atrás em velocidade e eficiência de custos.

Além disso, seu desempenho no CharXiv Reasoning (73,2%) e no Video-MMMU (84,8%) demonstra que seus recursos multimodais são robustos o suficiente para síntese de gráficos complexos e aquisição de conhecimento a partir de vídeo.

A hierarquia de inteligência: Flash-Lite vs. 3.1 Pro

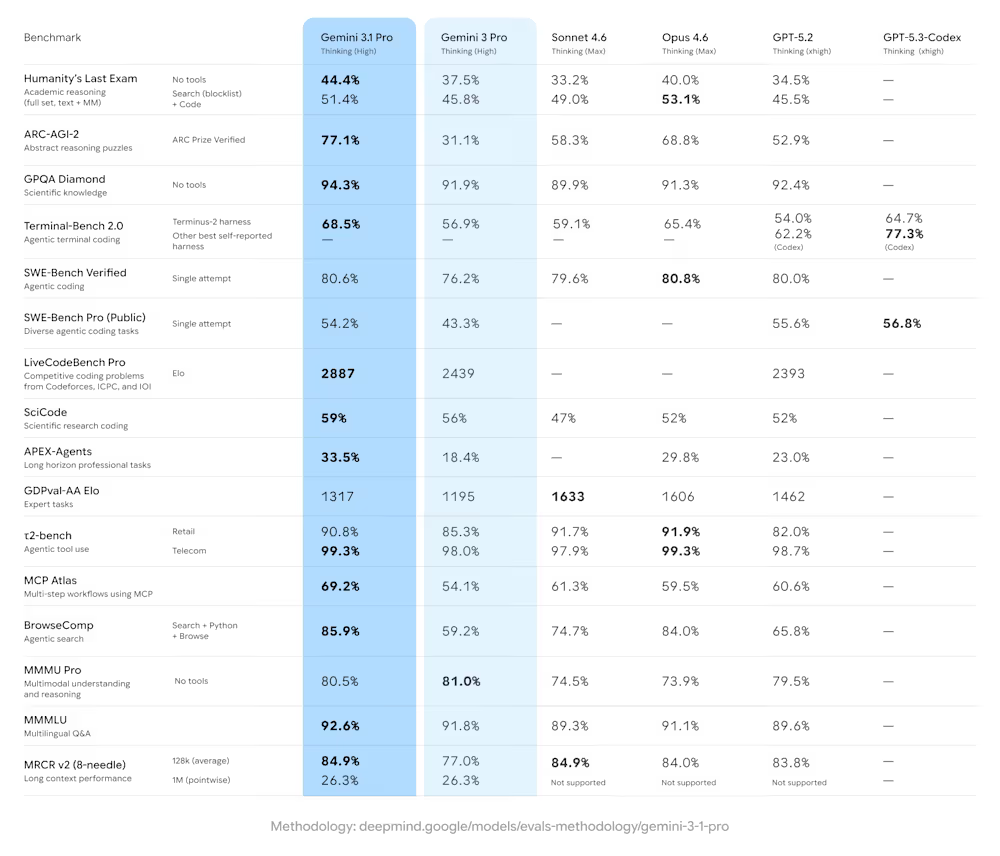

Para entender o lugar do Flash-Lite no mercado, é preciso olhar para ele junto com o Gemini 3.1 Pro, que o Google lançou em meados de fevereiro de 2026 para retomar a coroa da IA. Enquanto o Flash-Lite é o reflexo do sistema Gemini, o 3.1 Pro é sem dúvida o cérebro.

O principal diferenciador é a profundidade do processamento cognitivo. O Gemini 3.1 Pro foi projetado para dobrar o desempenho de raciocínio da geração anterior, alcançando uma pontuação verificada de 77,1% no ARC-AGI-2 – um benchmark projetado para testar a capacidade de um modelo de resolver padrões lógicos inteiramente novos que não encontrou durante o treinamento.

Embora o Flash-Lite se mantenha em conhecimento científico com 86,9%, o modelo Pro ultrapassa esse limite para impressionantes 94,3%, tornando-o a escolha superior para pesquisas profundas e sínteses de alto risco. O foco da aplicação também difere significativamente com base nessas lacunas de raciocínio.

O Gemini 3.1 Pro é capaz de codificar vibrações – gerando SVGs animados e simulações 3D complexas diretamente a partir de prompts de texto. Por exemplo, em uma demonstração, Pro codificou um complexo murmúrio de estorninho em 3D que os usuários poderiam manipular por meio de rastreamento manual. Pode até raciocinar através de temas literários abstratos, como traduzir o tom atmosférico de Wuthering Heights, de Emily Brontë, em um web design funcional.

Gemini 3.1 Flash-Lite, por outro lado, é o carro-chefe para execução de alto volume. Ele lida com milhões de tarefas diárias (tradução, marcação e moderação) que exigem resultados consistentes e repetíveis sem a enorme sobrecarga computacional de um modelo com muito raciocínio.

Ele preenche um wireframe com centenas de produtos instantaneamente ou orquestra o roteamento de intenções com 94% de precisão, conforme relatado pelos primeiros testadores.

1/8º do custo do modelo principal Gemini 3.1 Pro (e mais barato que seu antecessor, Flash-Lite 2.5)

Para os tomadores de decisões técnicas empresariais, a parte mais atraente da série Gemini 3.1 é a relação entre o raciocínio e o dólar.

O Google fixou o preço Gemini 3.1 Flash-Lite a US$ 0,25 por 1 milhão de tokens de entrada e US$ 1,50 por 1 milhão de tokens de saída.

Esse preço o torna significativamente mais acessível do que concorrentes como Claude 4.5 Haiku, que custa US$ 1,00 por 1 milhão de tokens de entrada e US$ 5,00 por 1 milhão de tokens de saída.

Mesmo comparado ao Gemini 2.5 Flash, que custa US$ 0,30 por 1 milhão de entradas, o Flash-Lite oferece uma redução de custos juntamente com seus ganhos de desempenho.

Quando comparado com o Gemini 3.1 Pro – que mantém um preço de US$ 2,00 por milhão de tokens de entrada para prompts de até 200 mil – a vantagem estratégica da abordagem de modelo duplo fica clara. Em uso de alto contexto (acima de 200.000 tokens por interação), O Flash-Lite é, na verdade, entre 12x e 16x mais barato.

|

Modoel |

Entrada |

Saída |

Custo total |

Fonte |

|

Qwen3 Turbo |

US$ 0,05 |

US$ 0,20 |

US$ 0,25 |

|

|

Qwen3.5-Flash |

US$ 0,10 |

US$ 0,40 |

US$ 0,50 |

|

|

deepseek-chat (V3.2-Exp) |

US$ 0,28 |

US$ 0,42 |

US$ 0,70 |

|

|

raciocinador de busca profunda (V3.2-Exp) |

US$ 0,28 |

US$ 0,42 |

US$ 0,70 |

|

|

Grok 4.1 Rápido (raciocínio) |

US$ 0,20 |

US$ 0,50 |

US$ 0,70 |

|

|

Grok 4.1 Rápido (sem raciocínio) |

US$ 0,20 |

US$ 0,50 |

US$ 0,70 |

|

|

MiniMax M2.5 |

US$ 0,15 |

US$ 1,20 |

US$ 1,35 |

|

|

Gêmeos 3.1 Flash-Lite |

US$ 0,25 |

US$ 1,50 |

US$ 1,75 |

|

|

MiniMax M2.5-Relâmpago |

US$ 0,30 |

US$ 2,40 |

US$ 2,70 |

|

|

Pré-visualização em Flash do Gêmeos 3 |

US$ 0,50 |

US$ 3,00 |

US$ 3,50 |

|

|

Kimi-k2.5 |

US$ 0,60 |

US$ 3,00 |

US$ 3,60 |

|

|

GLM-5 |

US$ 1,00 |

US$ 3,20 |

US$ 4,20 |

|

|

ERNIE 5.0 |

US$ 0,85 |

US$ 3,40 |

US$ 4,25 |

|

|

Claude Haiku 4.5 |

US$ 1,00 |

US$ 5,00 |

US$ 6,00 |

|

|

Qwen3-Max (23/01/2026) |

US$ 1,20 |

US$ 6,00 |

US$ 7,20 |

|

|

Gêmeos 3 Pro (≤200K) |

US$ 2,00 |

US$ 12,00 |

US$ 14,00 |

|

|

GPT-5.2 |

US$ 1,75 |

US$ 14,00 |

US$ 15,75 |

|

|

Soneto de Claude 4.5 |

US$ 3,00 |

US$ 15,00 |

US$ 18,00 |

|

|

Gêmeos 3 Pro (>200K) |

US$ 4,00 |

US$ 18,00 |

US$ 22,00 |

|

|

Claude Opus 4.6 |

US$ 5,00 |

US$ 25,00 |

US$ 30,00 |

|

|

GPT-5.2 Pró |

US$ 21,00 |

US$ 168,00 |

US$ 189,00 |

Ao usar uma arquitetura em cascata, uma empresa pode usar o 3.1 Pro para o planejamento inicial complexo, projeto arquitetônico e lógica profunda e, em seguida, transferir a execução repetitiva e de alta frequência para o Flash-Lite por um oitavo do custo.

Essa mudança efetivamente transfere a IA de um caro centro de custo experimental para um recurso de nível utilitário que pode ser executado em todos os arquivos de log, e-mail e bate-papo do cliente sem esgotar o orçamento da nuvem.

Reações da comunidade e dos desenvolvedores

Os primeiros comentários da rede de parceiros do Google sugerem que a série 3.1 está preenchendo com sucesso uma lacuna crítica no mercado de autonomia confiável.

Andrew Carr, cientista-chefe da Cartwheel, testou ambos os modelos e observou seus pontos fortes únicos. Em relação ao 3.1 Pro, ele destacou sua compreensão substancialmente melhorada das transformações 3D, que resolveu erros de ordem de rotação de longa data em pipelines de animação.

No entanto, ele descobriu que o Flash-Lite é um tipo diferente de desbloqueio para o negócio: “3.1 Flash-Lite é um modelo extremamente competente. É extremamente rápido, mas ainda assim encontra uma maneira de seguir todas as instruções… A relação inteligência/velocidade é incomparável em qualquer outro modelo”.

Para aplicações voltadas para o consumidor, a baixa latência do Flash-Lite tem sido a chave para a expansão do mercado.

Kolby Nottingham, chefe de IA da Latitude, compartilhou que o modelo alcançou uma taxa de sucesso 20% maior e tempos de inferência 60% mais rápidos em comparação com o modelo anterior, permitindo uma narrativa sofisticada para um público muito mais amplo do que seria possível de outra forma.

A confiabilidade na marcação de dados também surgiu como um recurso de destaque. Bianca Rangecroft, CEO da Whering, relatou que ao integrar o 3.1 Flash-Lite em seu pipeline de classificação, eles alcançaram 100% de consistência na etiquetagem de itens, fornecendo uma base altamente confiável para sua atribuição de rótulos e aumentando a confiança em resultados estruturados.

Kaan Ortabas, cofundador da HubX, observou que, como mecanismo de orquestração raiz, o Flash-Lite forneceu conclusões em menos de 10 segundos com streaming quase instantâneo e 97% de conformidade de saída estruturada.

No lado principal, Vladislav Tankov, Diretor de IA da JetBrains, observou uma melhoria de qualidade de 15% no modelo Pro, enfatizando que ele é mais forte, mais rápido e mais eficiente, exigindo menos tokens de saída para atingir seus objetivos.

Licenciamento e disponibilidade empresarial

Tanto o Gemini 3.1 Flash-Lite quanto o Pro são oferecidos pelo Google AI Studio e Vertex AI. Como modelos proprietários, eles seguem um modelo comercial padrão de software como serviço, em vez de uma licença de código aberto.

A operação por meio da Vertex AI fornece raciocínio fundamentado dentro de um perímetro seguro, garantindo que cargas de trabalho de alto volume, como aquelas executadas pelo Databricks para alcançar os melhores resultados da categoria no benchmark OfficeQA, permaneçam protegidas por segurança de nível empresarial e garantias de residência de dados.

No entanto, eles também são limitados em termos de personalização e exigem conectividade persistente com a Internet, ao contrário de rivais puramente de código aberto, como a nova e poderosa série Qwen3.5 lançada pelo Alibaba nas últimas semanas.

O status atual de visualização do Flash-Lite permite que o Google refine a segurança e o desempenho com base no feedback real dos desenvolvedores antes da disponibilidade geral.

Para desenvolvedores que já estão construindo por meio da API Gemini, a transição para 3.1 Pro e Flash-Lite representa uma atualização direta de desempenho com preços iguais ou inferiores, reduzindo efetivamente a barreira de entrada para fluxos de trabalho de agentes complexos.

O veredicto: o novo padrão para IA utilitária

O lançamento do Gemini 3.1 Flash-Lite representa a peça final de um pivô estratégico para o Google. Embora a indústria esteja obcecada por raciocínios de última geração para os problemas mais complexos, a grande maioria do trabalho empresarial consiste em tarefas de alto volume, repetitivas, mas de alta precisão.

Ao fornecer o cérebro no Gemini 3.1 Pro e os reflexos no Gemini 3.1 Flash-Lite, o Google está sinalizando que a próxima fase da corrida da IA será vencida por modelos que podem pensar em um problema, mas também executar essa solução em escala.

Para o CTO ou líder técnico que decide qual modelo incorporar em seu roteiro de produtos para 2026, a série Gemini 3.1 oferece um argumento convincente: você não precisa mais pagar uma taxa de raciocínio para obter resultados instantâneos e confiáveis. À medida que o Flash-Lite é lançado hoje em versão prévia, a mensagem para a comunidade de desenvolvedores é clara: a barreira para a inteligência em escala não foi apenas reduzida – ela foi desmantelada.