Os pipelines RAG padrão são interrompidos quando as empresas tentam usá-los para implantações de agente LLM multisessão e de longo prazo. Esta é uma limitação crítica à medida que cresce a demanda por assistentes de IA persistentes.

xMemóriauma nova técnica desenvolvida por pesquisadores do King’s College London e do Alan Turing Institute, resolve isso organizando conversas em uma hierarquia pesquisável de temas semânticos.

Experimentos mostram que o xMemory melhora a qualidade das respostas e o raciocínio de longo alcance em vários LLMs, ao mesmo tempo que reduz os custos de inferência. De acordo com os pesquisadores, o uso de tokens cai de mais de 9.000 para cerca de 4.700 tokens por consulta em comparação com os sistemas existentes em algumas tarefas.

Para aplicações empresariais do mundo real, como assistentes de IA personalizados e ferramentas de suporte a decisões multisessão, isso significa que as organizações podem implantar agentes mais confiáveis e conscientes do contexto, capazes de manter uma memória coerente de longo prazo sem aumentar as despesas computacionais.

RAG não foi construído para isso

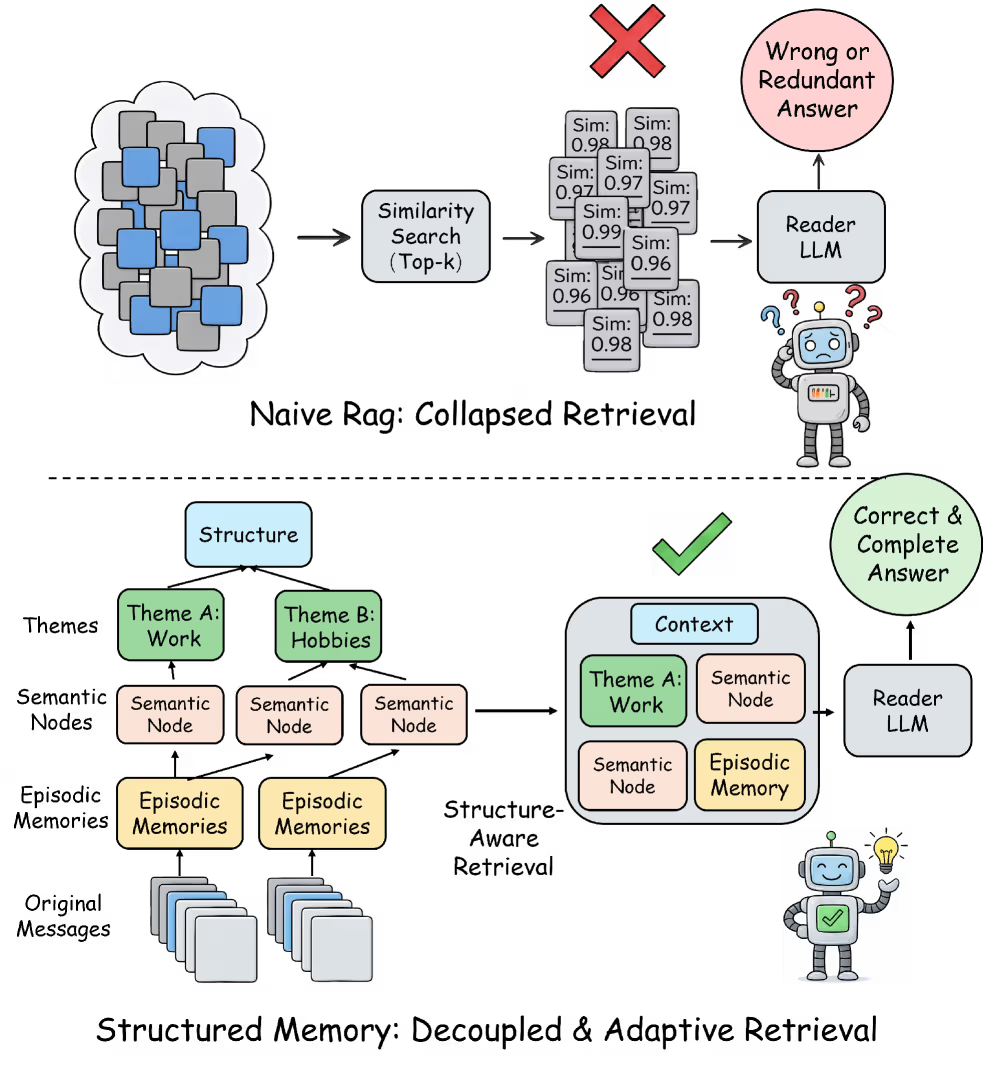

Em muitas aplicações LLM empresariais, uma expectativa crítica é que esses sistemas mantenham a coerência e a personalização em interações longas e multisessões. Para apoiar esse raciocínio de longo prazo, uma abordagem comum é usar RAG padrão: armazenar diálogos e eventos passados, recuperar um número fixo de correspondências principais com base na incorporação de similaridade e concatená-los em uma janela de contexto para gerar respostas.

No entanto, o RAG tradicional é construído para grandes bancos de dados onde os documentos recuperados são altamente diversos. O principal desafio é filtrar informações totalmente irrelevantes. A memória de um agente de IA, por outro lado, é um fluxo limitado e contínuo de conversação, o que significa que os blocos de dados armazenados são altamente correlacionados e frequentemente contêm quase duplicatas.

Para entender por que simplesmente aumentar a janela de contexto não funciona, considere como o RAG padrão lida com um conceito como frutas cítricas.

Imagine que um usuário teve muitas conversas dizendo coisas como “Eu adoro laranjas”, “Eu gosto de tangerinas” e, separadamente, outras conversas sobre o que é considerado uma fruta cítrica. O RAG tradicional pode tratar todos eles como semanticamente próximos e continuar recuperando trechos semelhantes “semelhantes a cítricos”.

“Se a recuperação colapsar em qualquer cluster que seja mais denso no espaço de incorporação, o agente pode obter muitas passagens altamente semelhantes sobre preferência, enquanto perde os fatos de categoria necessários para responder à consulta real”, disse Lin Gui, coautor do artigo, ao VentureBeat.

Uma solução comum para equipes de engenharia é aplicar poda ou compactação pós-recuperação para filtrar o ruído. Esses métodos assumem que as passagens recuperadas são altamente diversas e que padrões de ruído irrelevantes podem ser claramente separados de fatos úteis.

Esta abordagem é insuficiente na memória do agente conversacional porque o diálogo humano está “temporariamente emaranhado”, escrevem os investigadores. A memória conversacional depende muito de co-referências, reticências e dependências estritas da linha do tempo. Devido a essa interconexão, as ferramentas de poda tradicionais geralmente excluem acidentalmente partes importantes de uma conversa, deixando a IA sem o contexto vital necessário para raciocinar com precisão.

Por que a solução que a maioria das equipes busca piora as coisas

Para superar essas limitações, os pesquisadores propõem uma mudança na forma como a memória do agente é construída e pesquisada, o que eles descrevem como “desacoplamento para agregação”.

Em vez de combinar as consultas do usuário diretamente com os logs de bate-papo brutos e sobrepostos, o sistema organiza a conversa em uma estrutura hierárquica. Primeiro, ele desacopla o fluxo de conversação em componentes semânticos distintos e independentes. Esses fatos individuais são então agregados em uma hierarquia estrutural de temas de nível superior.

Quando a IA precisa recuperar informações, ela pesquisa de cima para baixo na hierarquia, passando dos temas à semântica e, finalmente, aos trechos brutos. Essa abordagem evita redundância. Se dois trechos de diálogo tiverem incorporações semelhantes, é improvável que o sistema os recupere juntos se tiverem sido atribuídos a componentes semânticos diferentes.

Para que esta arquitetura tenha sucesso, ela deve equilibrar duas propriedades estruturais vitais. Os componentes semânticos devem ser suficientemente diferenciados para evitar que a IA recupere dados redundantes. Ao mesmo tempo, as agregações de nível superior devem permanecer semanticamente fiéis ao contexto original para garantir que o modelo possa elaborar respostas precisas.

Uma hierarquia de quatro níveis que reduz a janela de contexto

Os pesquisadores desenvolveram o xMemory, uma estrutura que combina gerenciamento estruturado de memória com uma estratégia de pesquisa adaptativa de cima para baixo.

O xMemory organiza continuamente o fluxo bruto da conversa em uma hierarquia estruturada de quatro níveis. Na base estão as mensagens brutas, que são primeiro resumidas em blocos contíguos chamados “episódios”. A partir desses episódios, o sistema destila fatos reutilizáveis como semântica que separa o conhecimento central e de longo prazo dos registros repetitivos de bate-papo. Finalmente, a semântica relacionada é agrupada em temas de alto nível para torná-los facilmente pesquisáveis.

O xMemory usa uma função de objetivo especial para otimizar constantemente a forma como agrupa esses itens. Isto evita que as categorias fiquem demasiado inchadas, o que atrasa a pesquisa, ou demasiado fragmentadas, o que enfraquece a capacidade do modelo de agregar provas e responder a perguntas.

Quando recebe um prompt, o xMemory executa uma recuperação de cima para baixo nesta hierarquia. Começa nos níveis temático e semântico, selecionando um conjunto diversificado e compacto de fatos relevantes. Isso é crucial para aplicações do mundo real, onde as consultas dos usuários geralmente exigem a coleta de descrições em vários tópicos ou o encadeamento de fatos conectados para um raciocínio complexo e de vários saltos.

Uma vez obtido esse esqueleto de fatos de alto nível, o sistema controla a redundância por meio do que os pesquisadores chamam de “Gating de Incerteza”. Ele apenas faz uma busca detalhada para obter evidências mais refinadas e brutas no nível do episódio ou da mensagem se esse detalhe específico diminuir de forma mensurável a incerteza do modelo.

“A similaridade semântica é um sinal de geração de candidatos; a incerteza é um sinal de decisão”, disse Gui. “A similaridade diz o que está próximo. A incerteza diz o que realmente vale a pena pagar no orçamento imediato.” Ele para de se expandir quando detecta que adicionar mais detalhes não ajuda mais a responder à pergunta.

Quais são as alternativas?

Existente sistemas de memória de agente geralmente se enquadram em duas categorias estruturais: projetos planos e projetos estruturados. Ambos sofrem de limitações fundamentais.

Abordagens planas, como MemGPT registrar diálogo bruto ou rastreamentos minimamente processados. Isso captura a conversa, mas acumula redundância massiva e aumenta os custos de recuperação à medida que o histórico cresce.

Sistemas estruturados como A-MEM e o MemoryOS tentam resolver isso organizando as memórias em hierarquias ou gráficos. No entanto, eles ainda dependem de texto bruto ou minimamente processado como sua principal unidade de recuperação, muitas vezes extraindo contextos extensos e inchados. Esses sistemas também dependem fortemente de registros de memória gerados pelo LLM que possuem restrições de esquema estritas. Se a IA se desviar ligeiramente em sua formatação, poderá causar falha de memória.

O xMemory aborda essas limitações por meio de seu esquema de construção de memória otimizado, recuperação hierárquica e reestruturação dinâmica de sua memória à medida que ela cresce.

Quando usar xMemory

Para arquitetos corporativos, é fundamental saber quando adotar essa arquitetura em vez do RAG padrão. De acordo com Gui, “o xMemory é mais atraente quando o sistema precisa permanecer coerente durante semanas ou meses de interação”.

Os agentes de suporte ao cliente, por exemplo, se beneficiam muito com essa abordagem porque devem lembrar as preferências estáveis do usuário, os incidentes passados e o contexto específico da conta, sem gerar repetidamente tíquetes de suporte quase duplicados. O coaching personalizado é outro caso de uso ideal, exigindo que a IA separe as características duradouras do usuário dos detalhes episódicos do dia a dia.

Por outro lado, se uma empresa estiver construindo uma IA para conversar com um repositório de arquivos, como manuais de políticas ou documentação técnica, “uma pilha RAG mais simples ainda é a melhor escolha de engenharia”, disse Gui. Nesses cenários estáticos centrados em documentos, o corpus é diversificado o suficiente para que a recuperação padrão do vizinho mais próximo funcione perfeitamente bem sem a sobrecarga operacional da memória hierárquica.

O imposto de gravação vale a pena

O xMemory reduz o gargalo de latência associado à geração de resposta final do LLM. Em sistemas RAG padrão, o LLM é forçado a ler e processar uma janela de contexto inchada e cheia de diálogos redundantes. Como a recuperação precisa e de cima para baixo do xMemory cria uma janela de contexto muito menor e altamente direcionada, o leitor LLM gasta muito menos tempo de computação analisando o prompt e gerando a saída final.

Em seus experimentos em tarefas de longo contexto, os modelos abertos e fechados equipados com xMemory superaram outras linhas de base, usando consideravelmente menos tokens e aumentando a precisão da tarefa.

No entanto, essa recuperação eficiente tem um custo inicial. Para uma implantação empresarial, o problema do xMemory é que ele troca uma enorme taxa de leitura por uma taxa inicial de gravação. Embora, em última análise, torne a resposta às dúvidas dos usuários mais rápida e barata, a manutenção de sua arquitetura sofisticada requer um processamento em segundo plano substancial.

Ao contrário dos pipelines RAG padrão, que despejam incorporações de texto bruto de maneira barata em um banco de dados, o xMemory deve executar várias chamadas auxiliares LLM para detectar limites de conversação, resumir episódios, extrair fatos semânticos de longo prazo e sintetizar temas abrangentes.

Além disso, o processo de reestruturação do xMemory acrescenta requisitos computacionais adicionais, uma vez que a IA deve organizar, vincular e atualizar seu próprio sistema de arquivamento interno. Para gerenciar essa complexidade operacional na produção, as equipes podem executar essa reestruturação pesada de forma assíncrona ou em microlotes, em vez de bloquear de forma síncrona a consulta do usuário.

Para desenvolvedores ansiosos por prototipar, o código xMemory é publicamente disponível no GitHub sob uma licença do MIT, tornando-o viável para usos comerciais. Se você está tentando implementar isso em ferramentas de orquestração existentes, como LangChain, Gui aconselha focar primeiro na inovação principal: “A coisa mais importante a construir primeiro não é um prompt de recuperação mais sofisticado. É a camada de decomposição da memória. Se você acertar apenas uma coisa primeiro, torne-a a lógica de indexação e decomposição.”

A recuperação não é o último gargalo

Embora o xMemory ofereça uma solução poderosa para as limitações atuais das janelas de contexto, ele abre caminho para a próxima geração de desafios em fluxos de trabalho de agentes. À medida que os agentes de IA colaboram em horizontes mais longos, simplesmente encontrar as informações certas não será suficiente.

“A recuperação é um gargalo, mas uma vez que a recuperação melhora, esses sistemas rapidamente passam para o gerenciamento do ciclo de vida e a governança da memória como os próximos gargalos”, disse Gui. Navegar como os dados devem decair, lidar com a privacidade do usuário e manter a memória compartilhada entre vários agentes é exatamente “onde espero que grande parte da próxima onda de trabalho aconteça”, disse ele.