A criação de sistemas de IA autoaperfeiçoáveis é um passo importante para a implantação de agentes em ambientes dinâmicos, especialmente em ambientes de produção empresarial, onde as tarefas nem sempre são previsíveis nem consistentes.

Os atuais sistemas de IA auto-aperfeiçoáveis enfrentam severas limitações porque dependem de mecanismos de melhoria fixos e artesanais que só funcionam sob condições estritas, como a engenharia de software.

Para superar este desafio prático, pesquisadores da Meta e de várias universidades introduziram “hiperagentes”, um sistema de IA autoaperfeiçoável que reescreve e otimiza continuamente sua lógica de resolução de problemas e o código subjacente.

Na prática, isto permite que a IA se auto-aperfeiçoe em domínios não codificados, como robótica e revisão de documentos. O agente inventa de forma independente recursos de uso geral, como memória persistente e rastreamento automatizado de desempenho.

De forma mais ampla, os hiperagentes não apenas melhoram na resolução de tarefas, mas também aprendem a melhorar o ciclo de autoaperfeiçoamento para acelerar o progresso.

Esta estrutura pode ajudar a desenvolver agentes altamente adaptáveis que constroem autonomamente mecanismos de decisão estruturados e reutilizáveis. Essa abordagem combina recursos ao longo do tempo com menos necessidade de engenharia manual constante e de personalização humana específica de domínio.

IA atual de autoaperfeiçoamento e seus gargalos arquitetônicos

O objetivo principal do autoaperfeiçoamento dos sistemas de IA é aprimorar continuamente suas próprias capacidades de aprendizagem e resolução de problemas. No entanto, a maioria dos modelos de autoaperfeiçoamento existentes depende de um “metaagente” fixo. Este sistema supervisório estático de alto nível foi projetado para modificar um sistema básico.

“A principal limitação dos metaagentes artesanais é que eles só podem melhorar tão rápido quanto os humanos conseguem projetá-los e mantê-los”, disse Jenny Zhang, coautora do artigo, ao VentureBeat. “Cada vez que algo muda ou quebra, uma pessoa tem que intervir e atualizar as regras ou a lógica.”

Em vez de um limite teórico abstrato, isto cria um “muro de manutenção” prático.

O paradigma atual vincula a melhoria do sistema diretamente à velocidade da iteração humana, retardando o progresso porque depende fortemente do esforço manual de engenharia, em vez de escalar com a experiência coletada pelo agente.

Para superar esta limitação, os investigadores argumentam que o sistema de IA deve ser “totalmente autorreferencial”. Esses sistemas devem ser capazes de analisar, avaliar e reescrever qualquer parte de si mesmos sem as restrições de sua configuração inicial. Isto permite que o sistema de IA se liberte dos limites estruturais e se torne auto-acelerado.

Um exemplo de sistema de IA autorreferencial é o Sakana AI Máquina Darwin Gödel (DGM), um sistema de IA que se aprimora reescrevendo seu próprio código.

No DGM, um agente gera, avalia e modifica iterativamente seu próprio código, salvando variantes bem-sucedidas em um arquivo para atuar como trampolins para melhorias futuras. O DGM provou que o autoaperfeiçoamento recursivo e aberto é praticamente alcançável na codificação.

No entanto, o DGM fica aquém quando aplicado a aplicações do mundo real fora da engenharia de software devido a uma lacuna crítica de competências. No DGM, o sistema melhora porque tanto a avaliação quanto a automodificação são tarefas de codificação. Melhorar a capacidade de codificação do agente melhora naturalmente sua capacidade de reescrever seu próprio código. Mas se você implantar o DGM para uma tarefa empresarial sem codificação, esse alinhamento será interrompido.

“Para tarefas como matemática, poesia ou revisão de artigos, melhorar o desempenho da tarefa não melhora necessariamente a capacidade do agente de modificar seu próprio comportamento”, disse Zhang.

As habilidades necessárias para analisar textos subjetivos ou dados de negócios são totalmente diferentes das habilidades necessárias para analisar falhas e escrever novo código Python para corrigi-las.

O DGM também depende de um mecanismo fixo projetado por humanos para gerar suas instruções de autoaperfeiçoamento. Na prática, se os desenvolvedores corporativos quiserem usar o DGM para qualquer outra coisa que não seja codificação, eles deverão projetar e personalizar manualmente os prompts de instruções para cada novo domínio.

A estrutura do hiperagente

Para superar as limitações das arquiteturas anteriores, os pesquisadores introduzem hiperagentes. A estrutura propõe “agentes auto-referenciais que podem, em princípio, auto-aperfeiçoar-se para qualquer tarefa computável”.

Nesta estrutura, um agente é qualquer programa computável que pode invocar LLMs, ferramentas externas ou componentes aprendidos. Tradicionalmente, esses sistemas são divididos em duas funções distintas: um “agente de tarefa” que executa o problema específico em questão e um “metaagente” que analisa e modifica os agentes. Um hiperagente funde o agente de tarefa e o meta-agente em um programa único, autorreferencial e editável.

Como todo o programa pode ser reescrito, o sistema pode modificar o mecanismo de autoaperfeiçoamento, um processo que os pesquisadores chamam de automodificação metacognitiva.

“Os hiperagentes não estão apenas aprendendo como resolver melhor as tarefas determinadas, mas também aprendendo como melhorar”, disse Zhang. “Com o tempo, isso leva à acumulação. Os hiperagentes não precisam redescobrir como melhorar em cada novo domínio. Em vez disso, eles retêm e desenvolvem melhorias no próprio processo de autoaperfeiçoamento, permitindo que o progresso se acumule nas tarefas.”

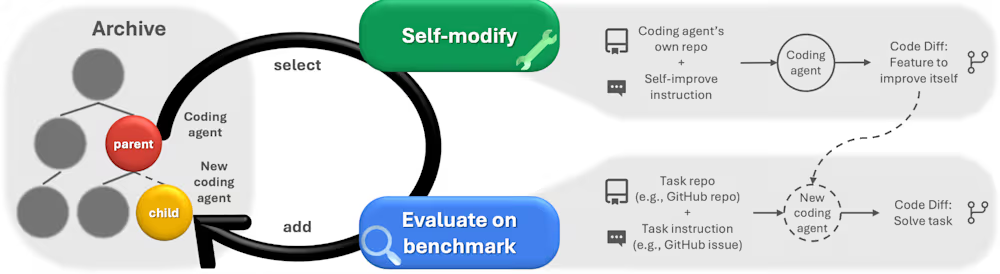

Os pesquisadores ampliaram a Máquina Darwin Gödel para criar Hiperagentes DGM (DGM-H). O DGM-H mantém a poderosa estrutura de exploração aberta do DGM original, o que evita que a IA convirja muito cedo ou fique presa em becos sem saída, mantendo um arquivo crescente de hiperagentes bem-sucedidos.

O sistema ramifica continuamente a partir de candidatos selecionados neste arquivo, permite que eles se automodifiquem, avalie as novas variantes em determinadas tarefas e adicione os bem-sucedidos de volta ao pool como trampolins para futuras iterações.

Ao combinar esta busca evolutiva aberta com a automodificação metacognitiva, o DGM-H elimina a etapa de instrução fixa e de engenharia humana do DGM original. Isso permite que o agente se auto-aperfeiçoe em qualquer tarefa computável.

Hiperagentes em ação

Os pesquisadores usaram o Referência de codificação poliglota para comparar a estrutura do hiperagente com a IA anterior somente de codificação. Eles também avaliaram hiperagentes em domínios não codificantes que envolvem raciocínio subjetivo, uso de ferramentas externas e lógica complexa.

Isso incluiu revisão de artigos para simular um revisor de pares produzindo decisões de aceitação ou rejeição, design de modelo de recompensa para treinar um robô quadrúpede e classificação de matemática em nível de olimpíada. A avaliação matemática serviu como um teste para ver se uma IA que aprendeu como se autoaperfeiçoar enquanto revisava trabalhos e projetava robôs poderia transferir essas meta-habilidades para um domínio totalmente invisível.

Os pesquisadores compararam hiperagentes com várias linhas de base, incluindo modelos específicos de domínio, como AI-Scientist-v2 para revisões de artigos e ProofAutoGrader para matemática. Eles também testaram o DGM clássico e um DGM personalizado manualmente para novos domínios.

No benchmark de codificação, os hiperagentes corresponderam ao desempenho do DGM, apesar de não terem sido projetados especificamente para codificação. Na revisão de artigos e na robótica, os hiperagentes superaram as linhas de base de código aberto e as funções de recompensa projetadas por humanos.

Quando os pesquisadores pegaram um hiperagente otimizado para revisão de artigos e robótica e o implantaram na tarefa de avaliação matemática invisível, ele alcançou uma métrica de melhoria de 0,630 em 50 iterações. As linhas de base que dependem de arquiteturas DGM clássicas permaneceram estáveis em 0,0. O hiperagente superou até mesmo o ProofAutoGrader específico do domínio.

Os experimentos também destacaram comportamentos autônomos interessantes de hiperagentes. Na avaliação em papel, o agente primeiro usou truques padrão de engenharia imediata, como adotar uma personalidade rigorosa. Quando isso se mostrou pouco confiável, ela reescreveu seu próprio código para construir um pipeline de avaliação em vários estágios com listas de verificação explícitas e regras de decisão rígidas, levando a uma consistência muito maior.

Os hiperagentes também desenvolveram de forma autônoma uma ferramenta de memória para evitar a repetição de erros do passado. Além disso, o sistema escreveu um rastreador de desempenho para registrar e monitorar o resultado das mudanças arquitetônicas ao longo das gerações. O modelo até desenvolveu um comportamento consciente do orçamento computacional, onde rastreou as iterações restantes para ajustar seu planejamento. As primeiras gerações executaram mudanças arquitetônicas ambiciosas, enquanto as gerações posteriores se concentraram em refinamentos conservadores e incrementais.

Para equipes de dados corporativos que estão se perguntando por onde começar, Zhang recomenda focar em tarefas onde o sucesso é inequívoco. “Fluxos de trabalho claramente especificados e fáceis de avaliar, muitas vezes chamados de tarefas verificáveis, são o melhor ponto de partida”, disse ela. “Isso geralmente abre novas oportunidades para prototipagem mais exploratória, análise de dados mais exaustiva, testes A/B mais exaustivos, [and] engenharia de recursos mais rápida.” Para tarefas mais difíceis e não verificadas, as equipes podem usar hiperagentes para primeiro desenvolver juízes instruídos que reflitam melhor as preferências humanas, criando uma ponte para domínios mais complexos.

Os pesquisadores compartilharam o código para hiperagentesembora tenha sido lançado sob uma licença não comercial.

Advertências e ameaças futuras

Os benefícios dos hiperagentes apresentam compensações claras. Os pesquisadores destacam várias considerações de segurança em relação aos sistemas que podem se modificar de maneiras cada vez mais abertas.

Estes sistemas de IA representam o risco de evoluir muito mais rapidamente do que os humanos conseguem auditar ou interpretar. Embora os investigadores tenham contido o DGM-H dentro dos limites de segurança, tais como ambientes em área restrita concebidos para evitar efeitos secundários não intencionais, estas salvaguardas iniciais são, na verdade, planos de implantação práticos.

Zhang aconselha os desenvolvedores a impor limites de recursos e restringir o acesso a sistemas externos durante a fase de automodificação. “O princípio fundamental é separar a experimentação da implantação: permitir que o agente explore e melhore dentro de uma sandbox controlada, garantindo ao mesmo tempo que quaisquer alterações que afetem os sistemas reais sejam cuidadosamente validadas antes de serem aplicadas”, disse ela. Somente depois que o código recém-modificado passar nas verificações de correção definidas pelo desenvolvedor ele deverá ser promovido para uma configuração de produção.

Outro perigo significativo são os jogos de avaliação, onde a IA melhora as suas métricas sem fazer progresso real em direção ao objetivo pretendido no mundo real. Como os hiperagentes são guiados por sinais de avaliação empírica, podem descobrir de forma autónoma estratégias que exploram pontos cegos ou fraquezas no próprio procedimento de avaliação para inflacionar artificialmente as suas pontuações. Prevenir esse comportamento exige que os desenvolvedores implementem protocolos de avaliação diversos, robustos e atualizados periodicamente, juntamente com supervisão humana contínua.

Em última análise, estes sistemas irão mudar as responsabilidades diárias dos engenheiros humanos. Assim como não recalculamos todas as operações executadas por uma calculadora, os futuros engenheiros de orquestração de IA não escreverão a lógica de melhoria diretamente, acredita Zhang.

Em vez disso, irão conceber os mecanismos de auditoria e testes de resistência do sistema. “À medida que os sistemas de auto-aperfeiçoamento se tornam mais capazes, a questão não é mais apenas como melhorar o desempenho, mas quais objetivos valem a pena perseguir”, disse Zhang. “Nesse sentido, a função evolui da construção de sistemas para a definição de sua direção.