Interfone está fazendo uma aposta incomum para uma empresa de software legado: construir seu próprio modelo de IA.

A plataforma massiva de atendimento ao cliente com sede em Dublin, Irlanda, com 15 anos de idade anunciado Fin Apex 1.0 na quinta-feira, um pequeno modelo de IA desenvolvido especificamente que a empresa afirma superar os principais modelos de fronteira da OpenAI e da Anthropic nas métricas que mais importam para o suporte ao cliente.

Os poderes do modelo Agente Fin AI existente da Intercomque já lida com mais de um milhão de conversas com clientes semanalmente.

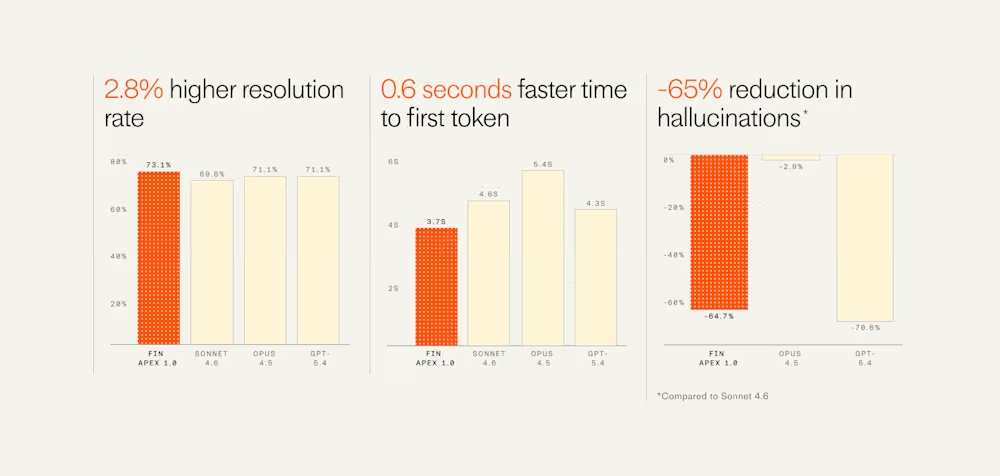

De acordo com benchmarks compartilhados com VentureBeat, Fin Apex 1.0 atinge uma taxa de resolução de 73,1% – a porcentagem de problemas de clientes totalmente resolvidos sem intervenção humana – em comparação com 71,1% para GPT-5.4 e Claude Opus 4.5 e 69,6% para Claude Sonnet 4.6. Essa margem de cerca de 2 pontos percentuais pode parecer modesta, mas é maior do que a diferença típica entre gerações sucessivas de modelos de fronteira.

“Se você está executando grandes operações de serviço em escala e tem 10 milhões de clientes ou um bilhão de dólares em receita, um delta de 2% ou 3% é uma quantidade realmente grande de clientes, interações e receitas”, disse o CEO da Intercom, Eoghan McCabe, ao VentureBeat em uma entrevista por videochamada no início desta semana.

O modelo também mostra melhorias significativas em velocidade e precisão. O Fin Apex fornece respostas em 3,7 segundos – 0,6 segundos mais rápido que o concorrente mais rápido – e demonstra uma redução de 65% nas alucinações em comparação com o Claude Sonnet 4.6.

Talvez o mais impressionante para os compradores empresariais: custa cerca de um quinto do custo do uso direto de modelos de fronteira e está incluído na estrutura de preços existente “por resultado” da Intercom para seus planos de clientes existentes.

Qual é o modelo básico? Isso importa?

Mas há um problema. Quando solicitado a especificar em qual modelo básico o Apex foi construído – e o tamanho de seu parâmetro – a Intercom recusou.

“Não estamos compartilhando o modelo básico que usamos para o Apex 1.0 – por razões competitivas e também porque planejamos mudar os modelos básicos ao longo do tempo”, disse um porta-voz da empresa ao VentureBeat. A empresa apenas confirmou que o modelo tem “o tamanho de centenas de milhões de parâmetros”.

Esse é um modelo notavelmente pequeno. Para efeito de comparação, o Llama 3.1 da Meta varia de 8 bilhões a 405 bilhões de parâmetros; mesmo modelos eficientes de peso aberto, como o Mistral 7B, superam a escala subbilionária que a Intercom descreve.

Se as afirmações de desempenho do Apex se sustentam nesse contexto – ou se os benchmarks refletem otimizações possíveis apenas em aplicações restritas e específicas de domínio – permanece uma questão em aberto.

A Intercom diz que aprendeu com a reação que a startup de codificação de IA Cursor enfrentou quando os críticos acusaram o assistente de codificação de enterrar o fato de que seu modelo Composer 2 foi construído em modelos de pesos abertos ajustados, em vez de tecnologia proprietária. Mas a lição que a Intercom tirou pode não satisfazer os céticos: a empresa é transparente ao afirmar que usou uma base de pesos abertos, mas não qual um.

“Somos muito transparentes por termos” usado um modelo de pesos abertos, disse o porta-voz. No entanto, recusar-se a nomear o modelo e ao mesmo tempo reivindicar transparência é uma contradição que provavelmente atrairá escrutínio – especialmente à medida que mais empresas promovem a IA “proprietária” que equivale a fundações de código aberto pós-treinadas.

Pós-treinamento como a nova fronteira

O argumento da Intercom é que o modelo básico simplesmente não importa mais.

“O pré-treinamento é uma espécie de mercadoria agora”, disse McCabe. “A fronteira, por assim dizer, está na verdade no pós-treinamento. O pós-treinamento é a parte difícil. Você precisa de dados proprietários. Você precisa de fontes proprietárias de verdade.”

A empresa pós-treinou a base escolhida usando anos de dados proprietários de atendimento ao cliente acumulados por meio do Fin, que agora resolve 2 milhões de consultas de clientes por semana. Esse processo envolveu mais do que apenas inserir transcrições em um modelo. A Intercom construiu sistemas de aprendizagem por reforço baseados em resultados reais de resolução, ensinando ao modelo como realmente é um atendimento ao cliente bem-sucedido – o tom apropriado, decisões de julgamento, estrutura de conversação e, de maneira crítica, como reconhecer quando um problema está realmente resolvido e quando um cliente ainda está frustrado.

“Os modelos genéricos são treinados em dados genéricos da Internet. Os modelos específicos são treinados em dados de domínio hiperespecíficos”, explicou McCabe. “É lógico, portanto, que a inteligência dos modelos genéricos é genérica, e a inteligência dos modelos específicos é específica do domínio e, portanto, opera de uma forma muito superior para esse caso de uso”.

Se McCabe estiver certo ao dizer que a magia está inteiramente no pós-treinamento, a relutância em nomear a base torna-se mais difícil de justificar. Se a base for verdadeiramente intercambiável, que vantagem competitiva o sigilo protege?

Uma aposta de US$ 100 milhões valendo a pena

O anúncio ocorre no momento em que o primeiro pivô de IA da Intercom parece estar funcionando. Fin está se aproximando de US$ 100 milhões em receita recorrente anual e crescendo 3,5x, tornando-se o segmento de crescimento mais rápido do negócio ARR de US$ 400 milhões da empresa. Projeta-se que Fin represente metade da receita total da Intercom no início do próximo ano.

Essa trajetória representa uma reviravolta notável. Quando o Fin foi lançado, sua taxa de resolução era de apenas 23%. Hoje, a média é de 67% entre os clientes, com algumas implantações de grandes empresas registrando taxas de até 75%.

Para que isso acontecesse, a Intercom aumentou sua equipe de IA de cerca de 6 para 60 pesquisadores nos últimos três anos – um investimento significativo para uma empresa que McCabe admite estar “em uma situação muito ruim” antes de seu pivô de IA. A taxa média de crescimento das empresas públicas de software fica em torno de 11%; A Intercom espera atingir um crescimento de 37% este ano.

“Somos de longe os primeiros na categoria a treinar o nosso próprio modelo”, disse McCabe. “Não há mais ninguém que terá isso por um ano ou mais.”

A especiação e especialização da IA

A tese de McCabe alinha-se com uma tendência mais ampla que Andrej Karpathy, antigo líder de IA na Tesla e OpenAI, descreveu recentemente como a “especiação” de modelos de IA – uma proliferação de sistemas especializados otimizados para tarefas restritas em vez de inteligência geral.

O atendimento ao cliente, argumenta McCabe, é especialmente adequado para essa abordagem. É um dos únicos dois ou três casos de uso de IA empresarial que encontraram tração econômica genuína até agora, ao lado de assistentes de codificação e IA potencialmente legal. Isso atraiu mais de um bilhão de dólares em financiamento de risco para concorrentes como Decagon e Sierra – e tornou o espaço, nas palavras de McCabe, “implacavelmente competitivo”.

A questão é se os modelos específicos de domínio representam uma vantagem duradoura ou uma arbitragem temporária que os laboratórios fronteiriços acabarão por fechar. McCabe acredita que os laboratórios enfrentam limitações estruturais.

“Talvez o futuro seja que a Anthropic tenha uma grande oferta de muitos modelos especializados diferentes. Talvez seja isso que parece”, disse ele. “Mas a realidade é que não creio que os modelos genéricos consigam acompanhar os modelos de domínio específico neste momento.”

Além da eficiência para experimentar

A adoção inicial da IA pelas empresas concentrou-se fortemente na redução de custos – substituindo agentes humanos caros por agentes automatizados mais baratos. Mas McCabe vê a conversa mudando em direção à qualidade da experiência.

“Originalmente era tipo, ‘Puta merda, podemos realmente fazer isso por muito mais barato.’ E agora eles estão pensando: ‘Espere, não, podemos oferecer aos clientes uma experiência muito melhor'”, disse ele.

A visão vai além da simples resolução de consultas. McCabe imagina agentes de IA que funcionam como consultores – um bot de varejista de calçados que não apenas responde a perguntas sobre envio, mas também oferece conselhos de estilo e mostra aos clientes como as diferentes opções podem parecer para eles.

“O atendimento ao cliente sempre foi uma merda”, disse McCabe sem rodeios. “Mesmo nas melhores marcas, você fica esperando uma ligação, circulando por diferentes departamentos. Agora existe uma oportunidade de fornecer uma experiência verdadeiramente perfeita ao cliente.”

Preço e disponibilidade

Para clientes Fin existentes, a atualização para Apex não tem custo adicional. A Intercom confirmou que o preço do cliente permanece inalterado – os usuários continuam pagando por resultado como antes, a US$ 0,99 por interação resolvida, e se beneficiam automaticamente do novo modelo.

O Apex não está disponível como modelo independente ou por meio de uma API externa. É acessível apenas através do Fin, o que significa que as empresas não podem licenciar o modelo de forma independente ou integrá-lo nos seus próprios produtos. Essa restrição pode limitar a capacidade da Intercom de rentabilizar o modelo para além da sua base de clientes existente – mas também mantém a tecnologia proprietária num sentido prático, independentemente de qual seja o modelo base subjacente.

O que vem a seguir

A Intercom planeja expandir o Fin além do atendimento ao cliente, para vendas e marketing – posicionando-o como um concorrente direto da visão Agentforce da Salesforce, que visa fornecer agentes de IA em todo o ciclo de vida do cliente.

Para a indústria mais ampla de SaaS, a decisão da Intercom levanta questões desconfortáveis. Se uma empresa de atendimento ao cliente com 15 anos de existência puder construir um modelo que supere OpenAI e Anthropic em seu domínio, o que isso significa para os fornecedores que ainda dependem de chamadas genéricas de API? E se “a pós-formação é a nova fronteira”, como insiste McCabe, será que as empresas que reivindicam avanços enfrentarão pressão para mostrar o seu trabalho – ou continuarão a esconder-se atrás do segredo competitivo enquanto promovem a transparência?

A resposta de McCabe à primeira pergunta, apresentado em uma postagem recente no LinkedIné severo: “Se você não pode se tornar uma empresa agente, seu negócio de aplicativos CRUD terá um futuro decrescente.”

A resposta para a segunda ainda está para ser vista.