Os engenheiros que criam agentes de navegador hoje enfrentam uma escolha entre APIs fechadas que não podem inspecionar e estruturas abertas sem nenhum modelo treinado por baixo delas. Ai2 oferece agora uma terceira opção.

A organização sem fins lucrativos com sede em Seattle por trás do OLMo de código aberto modelos de linguagem e Molmo A família Vision-Language está lançando hoje o MolmoWeb, um agente web visual de peso aberto disponível em tamanhos de parâmetros de 4 bilhões e 8 bilhões. Até agora, nenhum agente web visual de peso aberto enviado com os dados de treinamento e o pipeline necessários para auditá-los ou reproduzi-los. MolmoWeb faz. MolmoWebMix, o conjunto de dados que o acompanha, inclui 30.000 trajetórias de tarefas humanas em mais de 1.100 sites, 590.000 demonstrações de subtarefas individuais e 2,2 milhões de pares de perguntas e respostas de captura de tela – que Ai2 descreve como a maior coleção lançada publicamente de execução humana de tarefas web já montada.

“Você pode passar de apenas compreender passivamente as imagens, descrevê-las e legendá-las, para realmente fazê-las agir em algum ambiente?” Tanmay Gupta, cientista pesquisador sênior da Ai2, disse VentureBeat. “Isso é exatamente o que o MolmoWeb é.”

Como funciona: ele vê o que você vê

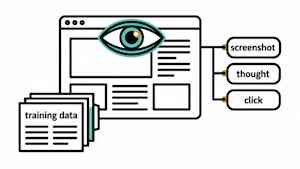

MolmoWeb opera inteiramente a partir de capturas de tela do navegador. Ele não analisa HTML nem depende de representações de árvore de acessibilidade de uma página. Em cada etapa, ele recebe uma instrução de tarefa, a captura de tela atual, um registro de texto das ações anteriores e o URL atual e o título da página. Ele produz um pensamento em linguagem natural que descreve seu raciocínio e, em seguida, executa a próxima ação do navegador – clicar nas coordenadas da tela, digitar texto, rolar, navegar até um URL ou alternar entre guias.

O modelo é independente do navegador. Requer apenas uma captura de tela, o que significa que é executado no Chrome local, Safari ou em um serviço de navegador hospedado. A demonstração hospedada usa o Browserbase, uma startup de infraestrutura de navegador em nuvem.

O conjunto de dados que o faz funcionar

Os pesos dos modelos são apenas parte do que a Ai2 está lançando. MolmoWebMix, o conjunto de dados de treinamento que o acompanha, é o principal diferencial de todos os outros agentes abertos disponíveis atualmente.

“Os dados basicamente parecem uma sequência de capturas de tela e ações combinadas com instruções sobre qual era a intenção por trás dessa sequência de capturas de tela”, disse Gupta.

MolmoWebMix combina três componentes.

Demonstrações humanas. Anotadores humanos concluíram tarefas de navegação usando uma extensão personalizada do Chrome que registrou ações e capturas de tela em mais de 1.100 sites. O resultado são 30.000 trajetórias de tarefas abrangendo mais de 590.000 demonstrações de subtarefas individuais.

Trajetórias sintéticas. Para ir além do que a anotação humana por si só pode fornecer, o Ai2 gerou trajetórias adicionais usando agentes de árvore de acessibilidade baseados em texto – execuções de agente único filtradas para sucesso de tarefas, pipelines multiagentes que decompõem tarefas em subobjetivos e caminhos de navegação determinísticos em centenas de sites. Criticamente, nenhum agente de visão proprietário foi usado. Os dados sintéticos vieram de sistemas somente texto, não do OpenAI Operator ou da API de uso de computador da Anthropic.

Dados de percepção da GUI. Um terceiro componente treina o modelo para ler e raciocinar sobre o conteúdo da página diretamente a partir de imagens. Inclui mais de 2,2 milhões de pares de perguntas e respostas de captura de tela extraídos de quase 400 sites, cobrindo tarefas de fundamentação de elementos e raciocínio baseado em capturas de tela.

“Se você é capaz de executar uma tarefa e registrar uma trajetória a partir dela, deverá ser capaz de treinar o agente da web nessa trajetória para fazer exatamente a mesma tarefa”, disse Gupta.

Como o MolmoWeb se compara à concorrência

Na opinião de Gupta, existem duas categorias de tecnologias no mercado de agentes de navegador.

O primeiro são sistemas somente API, capazes, mas fechados, sem visibilidade de treinamento ou arquitetura. Operador OpenAI, API de uso de computador da Anthropic e uso de computador Gemini do Google se enquadram neste grupo. O segundo são os modelos abertos, uma categoria significativamente menor. O uso do navegador, a alternativa aberta mais amplamente adotada, é uma estrutura e não um modelo treinado. Exige que os desenvolvedores forneçam seu próprio LLM e construam a camada de agente por cima.

MolmoWeb se enquadra na segunda categoria como um modelo de visão de peso aberto totalmente treinado. Ai2 relata que lidera esse grupo em quatro benchmarks de sites ao vivo: WebVoyager, Online-Mind2Web, DeepShop e WebTailBench. De acordo com Ai2, ele também supera os agentes mais antigos baseados em API construídos em GPT-4o com árvore de acessibilidade e entrada de captura de tela.

Ai2 documenta diversas limitações atuais na versão. O modelo comete erros ocasionais ao ler texto de capturas de tela, as interações de arrastar e soltar permanecem não confiáveis e o desempenho diminui em instruções ambíguas ou fortemente restritas. O modelo também não foi treinado em tarefas que exigem logins ou transações financeiras.

As equipes empresariais que avaliam os agentes navegadores não estão apenas escolhendo um modelo. Eles estão decidindo se podem auditar o que estão executando, ajustá-lo em fluxos de trabalho internos e evitar uma dependência de API por chamada.