Os sistemas multiagentes, projetados para lidar com tarefas de longo prazo, como engenharia de software ou triagem de segurança cibernética, podem gerar até 15 vezes o volume de tokens dos bate-papos padrão – ameaçando sua relação custo-benefício no tratamento de tarefas empresariais.

Mas hoje, a Nvidia procurou ajudar a resolver este problema com o lançamento do Nemotron 3 Superum modelo híbrido de 120 bilhões de parâmetros, com pesos publicados em Abraçando o rosto.

Ao mesclar filosofias arquitetônicas díspares – modelos de espaço de estado, transformadores e um novo design “latente” de mistura de especialistas – a Nvidia está tentando fornecer a profundidade especializada necessária para fluxos de trabalho de agentes sem o inchaço típico dos modelos de raciocínio denso e todos disponíveis para uso comercial sob pesos principalmente abertos.

Arquitetura híbrida tripla

No centro do Nemotron 3 Super está uma tríade arquitetônica sofisticada que equilibra eficiência de memória com raciocínio preciso. O modelo utiliza um Backbone híbrido Mamba-Transformerque intercala camadas do Mamba-2 com camadas estratégicas de atenção do Transformer.

Para compreender as implicações para a produção empresarial, consideremos o problema da “agulha num palheiro”. As camadas Mamba-2 atuam como um sistema rodoviário de “viagem rápida”, lidando com a grande maioria do processamento de sequência com complexidade de tempo linear. Isso permite que o modelo mantenha uma enorme janela de contexto de 1 milhão de tokens sem que o consumo de memória do cache KV exploda. No entanto, os modelos puros de espaço de estados muitas vezes lutam com a recordação associativa.

Para corrigir isso, a Nvidia insere estrategicamente camadas de atenção do Transformer como “âncoras globais”, garantindo que o modelo possa recuperar com precisão fatos específicos enterrados profundamente em uma base de código ou em uma pilha de relatórios financeiros.

Além do backbone, o modelo introduz Mistura Latente de Especialistas (LatentMoE). A mistura tradicional de especialistas (MoE) projeta tokens de rota para especialistas em toda a sua dimensão oculta, o que cria um gargalo computacional à medida que os modelos são dimensionados. O LatentMoE resolve isso projetando tokens em um espaço compactado antes de encaminhá-los para especialistas.

Essa “compressão especializada” permite que o modelo consulte quatro vezes mais especialistas pelo mesmo custo computacional. Essa granularidade é vital para agentes que precisam alternar entre sintaxe Python, lógica SQL e raciocínio conversacional em um único turno.

Acelerando ainda mais o modelo está a Predição Multi-Token (MTP). Enquanto os modelos padrão preveem um único próximo token, o MTP prevê vários tokens futuros simultaneamente. Isso serve como um “modelo de rascunho integrado”, permitindo a decodificação especulativa nativa que pode fornecer velocidades de clock de até 3x para tarefas de geração estruturadas, como código ou chamadas de ferramentas.

A vantagem da Blackwell

Para as empresas, o salto técnico mais significativo do Nemotron 3 Super é a sua otimização para a plataforma GPU Nvidia Blackwell. Ao pré-treinar nativamente em NVFP4 (ponto flutuante de 4 bits), a Nvidia alcançou um avanço na eficiência de produção.

Na Blackwell, o modelo oferece inferência 4x mais rápida do que os modelos de 8 bits executados na arquitetura Hopper anterior, sem perda de precisão.

Na prática, o Nemotron 3 Super é uma ferramenta especializada para raciocínio agente.

Atualmente ocupa a posição número 1 no DeepResearch Bench, uma referência que mede a capacidade de uma IA de conduzir pesquisas completas e em várias etapas em grandes conjuntos de documentos.

|

Referência |

Nemotron 3 Super |

Qwen3.5-122B-A10B |

GPT-OSS-120B |

|

Conhecimento Geral |

|||

|

MMLU-Pro |

83,73 |

86,70 |

81,00 |

|

Raciocínio |

|||

|

AIME25 (sem ferramentas) |

90,21 |

90,36 |

92,50 |

|

HMMT 25 de fevereiro (sem ferramentas) |

93,67 |

91,40 |

90,00 |

|

HMMT 25 de fevereiro (com ferramentas) |

94,73 |

89,55 |

– |

|

GPQA (sem ferramentas) |

79,23 |

86,60 |

80,10 |

|

GPQA (com ferramentas) |

82,70 |

– |

80.09 |

|

LiveCodeBench (v5 2024-07↔2024-12) |

81.19 |

78,93 |

88,00 |

|

SciCode (subtarefa) |

42.05 |

42h00 |

39h00 |

|

HLE (sem ferramentas) |

18h26 |

25h30 |

14h90 |

|

HLE (com ferramentas) |

22,82 |

– |

19,0 |

|

Agente |

|||

|

Banco Terminal (subconjunto rígido) |

25,78 |

26,80 |

24h00 |

|

Núcleo de Bancada Terminal 2.0 |

31h00 |

37,50 |

18h70 |

|

Banco SWE (OpenHands) |

60,47 |

66,40 |

41,9 |

|

Banco SWE (OpenCode) |

59,20 |

67,40 |

– |

|

Banco SWE (Codex) |

53,73 |

61,20 |

– |

|

SWE-Bench Multilíngue (OpenHands) |

45,78 |

– |

30,80 |

|

TauBench V2 |

|||

|

Companhia aérea |

56,25 |

66,0 |

49,2 |

|

Varejo |

62,83 |

62,6 |

67,80 |

|

Telecomunicações |

64,36 |

95,00 |

66,00 |

|

Média |

61,15 |

74,53 |

61,0 |

|

BrowseComp com pesquisa |

31.28 |

– |

33,89 |

|

Banco PÁSSARO |

41,80 |

– |

38,25 |

|

Bate-papo e acompanhamento de instruções |

|||

|

IFBench (prompt) |

72,56 |

73,77 |

68,32 |

|

Escalar múltiplos desafios de IA |

55,23 |

61,50 |

58,29 |

|

Arena-Difícil-V2 |

73,88 |

75,15 |

90,26 |

|

Contexto longo |

|||

|

AA-LCR |

58,31 |

66,90 |

51,00 |

|

RÉGUA @ 256k |

96h30 |

96,74 |

52h30 |

|

RÉGUA @ 512k |

95,67 |

95,95 |

46,70 |

|

RÉGUA @ 1M |

91,75 |

91,33 |

22h30 |

|

Multilíngue |

|||

|

MMLU-ProX (média sobre idiomas) |

79,36 |

85.06 |

76,59 |

|

WMT24++ (pt→xx) |

86,67 |

87,84 |

88,89 |

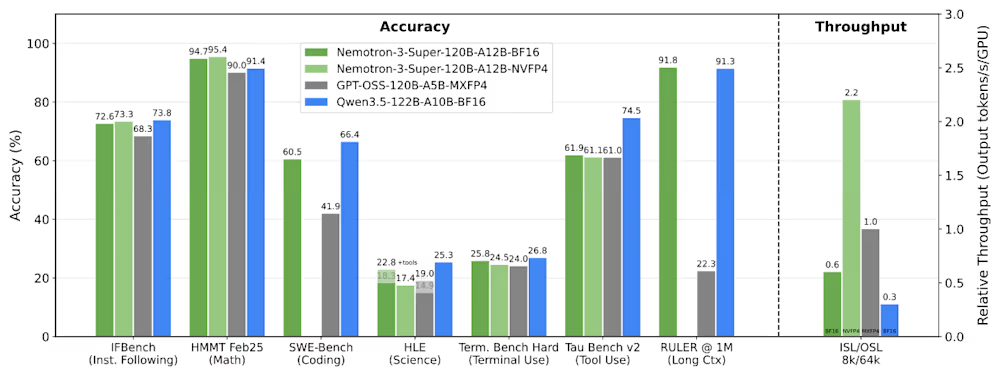

Ele também demonstra vantagens significativas de rendimento, alcançando rendimento até 2,2x maior que o gpt-oss-120B e 7,5x maior que o Qwen3.5-122B em configurações de alto volume.

Licença ‘aberta’ personalizada – uso comercial, mas com advertências importantes

O lançamento do Nemotron 3 Super sob o Contrato de licença de modelo aberto da Nvidia (atualizado em outubro de 2025) fornece uma estrutura permissiva para adoção empresarial, embora contenha cláusulas de “salvaguarda” distintas que a diferenciam de licenças puras de código aberto, como MIT ou Apache 2.0.

Principais disposições para usuários corporativos:

-

Usabilidade Comercial: A licença declara explicitamente que os modelos são “utilizáveis comercialmente” e concede uma licença perpétua, mundial e isenta de royalties para vender e distribuir produtos construídos com base no modelo.

-

Propriedade da saída: A Nvidia não reivindica os resultados gerados pelo modelo; a responsabilidade por esses resultados – e a propriedade deles – é inteiramente do usuário.

-

Obras Derivadas: As empresas são livres para criar e possuir “Modelos Derivados” (versões ajustadas), desde que incluam o aviso de atribuição exigido: “Licenciado pela Nvidia Corporation sob a licença Nvidia Open Model.”

As “Linhas Vermelhas”:

A licença inclui dois gatilhos críticos de rescisão que as equipes de produção devem monitorar:

-

Guarda-corpos de segurança: A licença termina automaticamente se um usuário ignorar ou contornar os “Guardrails” do modelo (limitações técnicas ou hiperparâmetros de segurança) sem implementar uma substituição “substancialmente semelhante” apropriada para o caso de uso.

-

Gatilho de litígio: Se um usuário iniciar um litígio de direitos autorais ou patentes contra a Nvidia, alegando que o modelo viola sua propriedade intelectual, sua licença para usar o modelo será encerrada imediatamente.

Essa estrutura permite que a Nvidia promova um ecossistema comercial enquanto se protege de “trollagem de IP” e garante que o modelo não seja despojado de seus recursos de segurança para uso malicioso.

‘A equipe realmente cozinhou’

O lançamento gerou um burburinho significativo na comunidade de desenvolvedores. Chris Alexiuk, engenheiro sênior de pesquisa de produto da Nvidia, anunciou o lançamento do X sob seu comando @llm_wizard como um “SUPER DIA”, enfatizando a rapidez e transparência do modelo. “O modelo é: RÁPIDO. O modelo é: INTELIGENTE. O modelo é: O MODELO MAIS ABERTO QUE JÁ FIZEMOS.” Chris postou, destacando o lançamento não apenas de pesos, mas de 10 trilhões de tokens de dados e receitas de treinamento.

A adoção pela indústria reflete esse entusiasmo:

-

Nuvem e Hardware: O modelo está sendo implantado como um Microsserviço Nvidia NIMpermitindo que ele seja executado no local por meio do Fábrica de IA da Dell ou HPEbem como no Google Cloud, Oracle e, em breve, AWS e Azure.

-

Agentes de Produção: Empresas como Código Coelho (desenvolvimento de software) e Greptil estão integrando o modelo para lidar com análises de base de código em larga escala, enquanto líderes industriais como Siemens e Palantir estão implantando-o para automatizar fluxos de trabalho complexos em manufatura e segurança cibernética.

Como observou Kari Briski, vice-presidente de software de IA da Nvidia: “À medida que as empresas vão além dos chatbots e entram em aplicações multiagentes, elas encontram… explosão de contexto.”

Nemotron 3 Super é a resposta da Nvidia a essa explosão – um modelo que fornece a “potência intelectual” de um sistema de parâmetros 120B com a eficiência operacional de um especialista muito menor. Para as empresas, a mensagem é clara: o “imposto do pensamento” está finalmente a diminuir.