Antes de a poeira baixar sobre as ruínas da escola Shajareh Tayyebeh – uma vítima dos recentes ataques militares dos EUA e de Israel contra o Irão, e que resultou na mortes de até 168 adultos e crianças – as pessoas já estavam cultivando engajamento online. Clipes de simuladores de vôo digitais foram apresentados como imagens de operações em tempo real, enquanto imagens fora de contexto de navios de guerra e vídeos antigos de ataques de mísseis aéreos foram reaproveitados para vender aos usuários uma história sobre o domínio iraniano. O conteúdo editado por IA proliferou.

Segundo especialistas, as postagens acumularam centenas de milhões de visualizações em apenas alguns dias.

A IA tornou todos nós alvos de vigilância. Esta ferramenta ajuda você a revidar.

O número crescente de postagens virais – e o potencial para que ainda mais surgissem à medida que os usuários ganhassem dinheiro com as falsidades virais – foi alarmante o suficiente para levar X a editar suas políticas sobre desinformação. A partir de ontem, X disse que suspenderá os usuários de seu programa Creator Revenue Sharing se eles postarem conteúdo gerado por IA retratando conflitos armados sem rotulá-los como tal.

E nem mesmo as pesquisas do Google estão protegidas contra desinformação hoje em dia.

A proliferação da desinformação digital é o produto de uma rede de bots e contas de engajamento, todas com o objetivo comum de ser a conta mais barulhenta e clicada na sala.

Alguns esperam ganhar influência política e social, outros querem apenas o dinheiro. Enquanto isso, os usuários, propensos ao viés de confirmação e à dependência de fontes de notícias digitais, são repetidamente vítimas de sua extorsão. A agricultura de engajamento, que não é mais apenas a troca da moeda de memes e clickbait, tornou-se um jogo perigoso e politicamente tenso.

O que os usuários estão vendo à medida que o conflito EUA-Irã se intensifica

Postagens recentes envolvendo desinformação activa sobre o conflito no Irão envolvem principalmente o exagero da escala e do sucesso dos contra-ataques iranianos, explicam os especialistas.

Uma investigação recente de Com fio documentou centenas de postagens no X de Elon Musk que incluíam imagens e fotos enganosas – incluindo conteúdo manipulado por IA – ou promoveram alegações falsas sobre a escala dos ataques, muitas das quais foram postadas logo após os ataques com mísseis. Uma postagem com mais de 4 milhões de visualizações afirmava mostrar mísseis balísticos navegando sobre Dubai, mas na verdade retratava um ataque iraniano a Tel Aviv em outubro de 2024. Outra com mais de 375.000 impressões mostra uma imagem fictícia de antes e depois do complexo bombardeado do líder iraniano assassinado Ali Hosseini Khamenei.

De acordo com a Wired, quase todas as postagens foram compartilhadas por contas de assinantes premium com marcas de seleção azuis, incluindo meios de comunicação financiados pelo Estado no Irã.

Tal como em conflitos militares anteriores, os relatos também tentaram fazer passar imagens de videojogos como clips de notícias verificados, incluindo imagens manipuladas por IA de caças F-35 abatidos, extraídas de jogos de simulador de voo. As imagens foram compartilhadas no TikTok, algumas com links para operações de influência russa, o BBC relatado.

Além de filmagens fora de contexto e conteúdo enganoso, a BBC também documentou um punhado de vídeos totalmente gerados por IA que acumularam quase 100 milhões de visualizações no total, compartilhados pelo que o meio de comunicação chama de notórios “superdifusores” de desinformação.

Os recursos visuais são uma boa maneira de processarmos o que está acontecendo na guerra quando não conseguimos compreender a escala desses conflitos.

UM relatório do cão de guarda de desinformação NewsGuard também narrou um grupo de usuários compartilhando postagens virais circulando falsas alegações de ataques militares direcionados contra fortalezas dos EUA e de Israel, predominantemente usando imagens de vídeo reaproveitadas e imagens de destruição fora de contexto ou completamente recontextualizadas.

“[These videos] são postados por contas anônimas que tendem a relatar conflitos geopolíticos. Estas são contas conhecidas pela NewsGuard por espalharem afirmações exageradas, geralmente de uma perspectiva pró-Irão”, disse Sofia Rubinson, editora sénior do boletim informativo Reality Check da NewsGuard e co-autora do relatório. A partir daí, explica Rubinson, outras contas com mais seguidores captam e espalham as falsas alegações.

Velocidade da luz mashável

Por exemplo, horas depois dos relatórios iniciais sobre os ataques militares dos EUA no Irão, os utilizadores do X começaram a publicar novamente a imagem de um porta-aviões naval a afundar-se. Os usuários alegaram que mostrava um ataque recente ao navio de guerra USS Abraham Lincoln no Mar da Arábia. O Comando Central dos militares dos EUA emitiu uma declaração refutando a afirmação naquele mesmo dia. O NewsGuard confirmou que a imagem realmente mostrava o naufrágio intencional do USS Oriskany, ocorrido há quase 20 anos. A afirmação foi compartilhada por contas de “notícias” não verificadas e até mesmo pelo parlamentar queniano Peter Salasya. A postagem de Salasya foi visualizada mais de 6 milhões de vezes.

Várias contas, incluindo a de Salasya, compartilharam outro vídeo que supostamente mostrava a usina nuclear israelense de Dimona sob cerco aéreo. O vídeo acumulou centenas de milhares de impressões em páginas anti-Israel e pró-Irã – uma X Nota da Comunidade aparece agora abaixo do vídeo na página de Salasya, esclarecendo que as imagens são de um ataque de março de 2017 em Balaklia, Ucrânia.

O NewsGuard descobriu que essas postagens já obtiveram pelo menos 21,9 milhões de visualizações em X.

Postagens que induzem ao medo de ataques retaliatórios domésticos também circularam on-line, incluindo uma lista não verificada de cidades dos EUA supostamente os principais alvos das células adormecidas iranianas – a lista parece ter sido escrita no aplicativo Notes da Apple.

A desinformação só vai piorar

A aceleração da IA generativa avançada e das políticas de moderação relaxadas nas plataformas de redes sociais exacerbou uma crise de desinformação online, alertaram os especialistas.

Especialmente nos últimos meses, incluindo durante a captura do líder venezuelano Nicolás Maduro, liderada pelos EUA, os investigadores da NewsGuard notaram um padrão na desinformação online emergente durante os períodos de notícias de última hora.

“As pessoas agora têm uma janela mais curta para o lapso entre a ocorrência de um evento e as imagens autênticas que saem da mídia”, explicou Rubinson. Para ser mais direto: os usuários estão perdendo a paciência, acostumados a um ambiente on-line onde as informações geralmente estão ao seu alcance.

Esses breves períodos, ou vazios, entre as notícias de última hora e os vídeos ou fotos confirmados tornam-se um terreno fértil para bots de desinformação e agricultores de engajamento, diz Rubinson. Ameaçam também reforçar o pensamento conspiratório – de que os principais meios de comunicação estão a ocultar informações do público, por exemplo – e prestam-se ao preconceito de confirmação do próprio utilizador.

Os conflitos políticos são particularmente abundantes na propagação dessa desinformação, que por sua vez é reforçada por campanhas activas de desinformação de ambos os lados do conflito armado. Os pesquisadores descobriram que um falta de proximidade com eventos torna mais fácil acreditar fora do contexto ou em informações exageradas.

“É uma tentativa de preencher esta névoa de guerra”, disse Rubsinson. “Pode ser muito opressor para as pessoas. Elas querem entender isso, e os recursos visuais são uma boa maneira de processarmos o que está acontecendo na guerra quando não conseguimos compreender a escala desses conflitos.”

Isto se torna um problema maior à medida que os indivíduos usam cada vez mais plataformas de mídia social como única fonte de notícias e à medida que ferramentas de verificação de factos anteriormente fiáveis, incluindo pesquisas simples no Google, se tornam menos fiáveis.

Governo dos EUA cria site para contornar proibições de conteúdo europeu

A IA está mais prejudicando do que ajudando

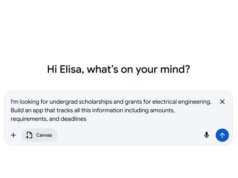

Os chatbots e a pesquisa de IA foram incorporados à própria fibra dos eventos de crise do mundo real, à medida que os usuários recorrem a eles verificadores de fatos em tempo real. Rubinson disse que quase todos os X posts analisados pelo NewsGuard incluíam a mesma resposta: “@Grok, isso é verdade?”

Mas os assistentes de IA e chatbots de plataforma, incluindo Grok do X, são notoriamente não confiável na divulgação e verificação de notícias de última hora. Eles também são inconsistentes na aplicação de suas próprias plataformas. políticas de moderação. A BBC descobriu que Grok verificou erroneamente imagens recentes geradas por IA que retratam movimentos militares iranianos, por exemplo.

De acordo com um segundo relatório publicado pela NewsGuard em 3 de março, os resumos de pesquisa baseados em IA do Google repetiram afirmações enganosas sobre o conflito EUA-Irã quando solicitados com pesquisas reversas de imagens. Por exemplo, os investigadores da NewsGuard carregaram um frame de um vídeo partilhado online que alegava mostrar a destruição de um posto avançado da CIA no Dubai. O resumo de IA do Google verificou a história, escrevendo: “A imagem mostra um incêndio em um prédio residencial em Dubai, Emirados Árabes Unidos, supostamente ocorrido em 1º de março de 2026, após tensões regionais.

Na verdade, o vídeo retrata um incêndio residencial em 2015 na cidade de Sharjah.

Especialistas em segurança soaram alarmes sobre tais “Ameaças à informação de IA“, incluindo ferramentas de IA usadas para gerar e amplificar conteúdo enganoso. Um relatório do Reino Unido Centro de Tecnologia Emergente e Segurança sugere que a deterioração do ambiente de informação pode representar ameaças existenciais à segurança pública, à segurança nacional e à democracia sem intervenção direta.

Entretanto, civis e jornalistas no terreno no Irão lutam contra uma quase apagão total da internetapós um grande esforço da administração Trump e de seu aliado Elon Musk para fornecer conexões de Internet Starlink para quem está no local. Os maus atores, por outro lado, ainda são encontrando o caminho através do quarteirão e de volta a sites como X.