Apesar da turbulência política no sector da IA dos EUA, na China, os avanços da IA continuam a ritmo acelerado sem problemas.

Hoje cedo, a equipe Qwen de pesquisadores de IA da gigante do comércio eletrônico Alibaba, focada principalmente no desenvolvimento e lançamento para o mundo de uma família crescente de linguagem de código aberto Qwen poderosa e capaz e modelos de IA multimodais, revelou seu mais novo lote, a série de modelos pequenos Qwen3.5que consiste em:

-

Qwen3.5-0.8B e 2B: Dois modelos, ambos otimizados para desempenho “minúsculo” e “rápido”, destinados à prototipagem e implantação em dispositivos de ponta onde a duração da bateria é fundamental.

-

Qwen3.5-4B: Uma forte base multimodal para agentes leves, com suporte nativo a uma janela de contexto de 262.144 tokens.

-

Qwen3.5-9B um modelo de raciocínio compacto que supera o código aberto gpt-oss-120B do rival americano OpenAI, 13,5 vezes maior, nos principais benchmarks de terceiros, incluindo conhecimento multilíngue e raciocínio de nível de pós-graduação

Para colocar isso em perspectiva, esses modelos estão na ordem dos menores modelos de uso geral enviados recentemente por qualquer laboratório ao redor do mundo, mais comparáveis ao ramo do MIT. Série LFM2 da LiquidAIque também têm várias centenas de milhões ou bilhões de parâmetros, do que os trilhões de parâmetros estimados (configurações de modelo) supostamente usados para os principais modelos da série OpenAI, Anthropic e Gemini do Google.

Os pesos dos modelos estão disponíveis globalmente sob licenças Apache 2.0 — perfeitos para uso empresarial e comercial, incluindo personalização conforme necessário — em Abraçando o rosto e ModelScope.

A tecnologia: eficiência híbrida e multimodalidade nativa

A base técnica da pequena série Qwen3.5 é diferente das arquiteturas padrão do Transformer. O Alibaba avançou em direção a uma arquitetura híbrida eficiente que combina redes Gated Delta (uma forma de atenção linear) com mistura de especialistas (MoE) esparsa.

Esta abordagem híbrida aborda o “muro de memória” que normalmente limita modelos pequenos; usando Gated Delta Networks, os modelos alcançam maior rendimento e latência significativamente menor durante a inferência.

Além disso, esses modelos são nativamente multimodais. Ao contrário das gerações anteriores que “incorporaram” um codificador de visão a um modelo de texto, o Qwen3.5 foi treinado usando fusão inicial em tokens multimodais. Isso permite que os modelos 4B e 9B exibam um nível de compreensão visual – como a leitura de elementos da interface do usuário ou a contagem de objetos em um vídeo – que anteriormente exigia modelos dez vezes maiores.

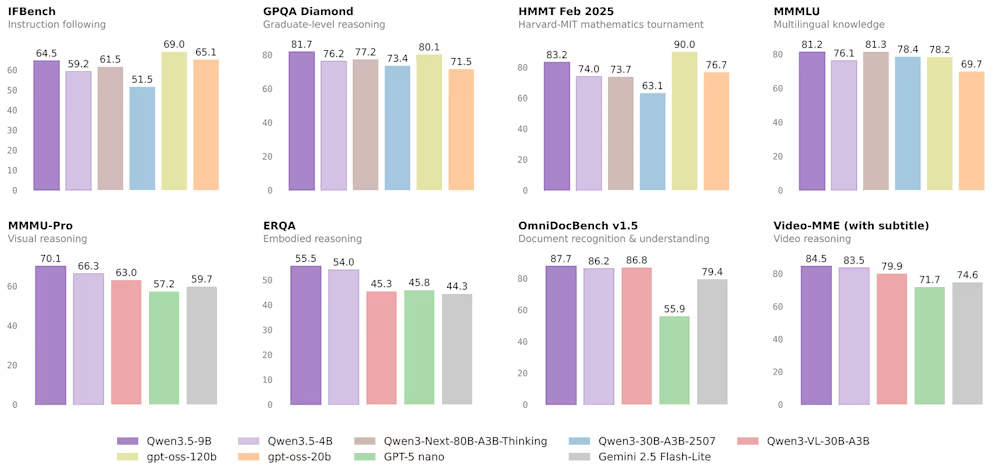

Benchmarking das séries “pequenas”: desempenho que desafia escala

Os dados de referência recentemente divulgados ilustram o quão agressivamente estes modelos compactos estão a competir com – e muitas vezes a superar – padrões industriais muito mais vastos. As variantes Qwen3.5-9B e Qwen3.5-4B demonstram um salto intergeracional em eficiência, particularmente em tarefas multimodais e de raciocínio.

Dominância multimodal: No benchmark de raciocínio visual MMMU-Pro, Qwen3.5-9B alcançou uma pontuação de 70,1, superando Gemini 2.5 Flash-Lite (59,7) e até mesmo o Qwen3-VL-30B-A3B especializado (63,0).

Raciocínio em nível de pós-graduação: No benchmark GPQA Diamond, o modelo 9B alcançou pontuação de 81,7, superando o gpt-oss-120b (80,1), modelo com mais de dez vezes sua contagem de parâmetros.

Compreensão do vídeo: A série mostra desempenho de elite em raciocínio de vídeo. No benchmark Video-MME (com legendas), Qwen3.5-9B pontuou 84,5 e o 4B pontuou 83,5, liderando significativamente sobre Gemini 2.5 Flash-Lite (74,6).

Habilidade matemática: Na avaliação do HMMT de fevereiro de 2025 (torneio de matemática Harvard-MIT), o modelo 9B obteve pontuação de 83,2, enquanto a variante 4B obteve pontuação de 74,0, provando que o raciocínio STEM de alto nível não requer mais clusters computacionais massivos.

Conhecimento documental e multilíngue: A variante 9B lidera o grupo em reconhecimento de documentos no OmniDocBench v1.5 com uma pontuação de 87,7. Enquanto isso, mantém uma presença multilíngue de alto nível no MMMLU com uma pontuação de 81,2, superando o gpt-oss-120b (78,2).

Reações da comunidade: “mais inteligência, menos computação”

Logo após o lançamento, na semana passada, de um Qwen3.5-Medium de código aberto já muito pequeno e poderoso, capaz de rodar em uma única GPU, o anúncio da série Qwen3.5-Small Models e seu tamanho ainda menor e requisitos de processamento despertaram interesse imediato entre os desenvolvedores focados na IA “local-first”.

“Mais inteligência, menos computação” repercutiu entre os usuários que buscavam alternativas aos modelos baseados em nuvem.

Educador de IA e tecnologia Paulo Couvert do Blueshell AI capturou o choque da indústria em relação a esse salto de eficiência.

“Como isso é possível?!” Couvert escreveu em X. “Qwen lançou 4 novos modelos e a versão 4B é quase tão capaz quanto a anterior 80B A3B. E o 9B é tão bom quanto o GPT OSS 120b, sendo 13x menor!”

A análise de Couvert destaca as implicações práticas destes ganhos arquitetônicos:

-

“Eles podem rodar em qualquer laptop”

-

“0,8B e 2B para o seu telefone”

-

“Off-line e código aberto”

Como desenvolvedor Karan Kendre do Kargul Studio disse: “esses modelos [can run] localmente no meu M1 MacBook Air gratuitamente.”

Esse sentimento de acessibilidade “incrível” ecoa em todo o ecossistema de desenvolvedores. Um usuário observou que um modelo 4B servindo como uma “forte base multimodal” é uma “virada de jogo para desenvolvedores móveis” que precisam de recursos de leitura de tela sem alta sobrecarga de CPU.

Na verdade, o desenvolvedor Hugging Face Xenova observou que a nova série Qwen3.5 Small Model pode até ser executada diretamente no navegador da web do usuário e executar operações sofisticadas e que anteriormente exigiam computação mais alta, como análise de vídeo.

Os pesquisadores também elogiaram o lançamento de Modelos básicos junto com as versões Instructobservando que fornece apoio essencial para a “inovação industrial no mundo real”.

O lançamento de modelos básicos é particularmente valorizado pelas equipes empresariais e de pesquisa porque fornece uma “folha em branco” que não foi influenciada por um conjunto específico de dados RLHF (Aprendizagem por Reforço a partir de Feedback Humano) ou SFT (Ajuste Fino Supervisionado), que muitas vezes pode levar a “recusas” ou estilos de conversação específicos que são difíceis de desfazer.

Agora, com os modelos Base, os interessados em customizar o modelo para se adequar a tarefas e propósitos específicos têm um ponto de partida mais fácil, pois agora podem aplicar seu próprio ajuste de instrução e pós-treinamento sem ter que retirar o do Alibaba.

Licenciamento: uma vitória para o ecossistema aberto

Alibaba lançou os pesos e arquivos de configuração para a série Qwen3.5 sob a licença Apache 2.0. Esta licença permissiva permite o uso comercial, modificação e distribuição sem pagamento de royalties, eliminando o “aprisionamento de fornecedor” associado a APIs proprietárias.

-

Uso comercial: Os desenvolvedores podem integrar modelos em produtos comerciais sem royalties.

-

Modificação: As equipes podem fazer ajustes finos (SFT) ou aplicar RLHF para criar versões especializadas.

-

Distribuição: Os modelos podem ser redistribuídos em aplicações de IA locais, como Ollama.

Contextualizando as notícias: por que o pequeno importa tanto agora

O lançamento do Qwen3.5 Small Series chega em um momento de “Realinhamento Agentic”. Ultrapassamos os chatbots simples; o objetivo agora é a autonomia. Um agente autônomo deve “pensar” (raciocinar), “ver” (multimodalidade) e “agir” (uso de ferramentas). Embora fazer isso com modelos de trilhões de parâmetros seja proibitivamente caro, um Qwen3.5-9B local pode executar esses loops por uma fração do custo.

Ao dimensionar o Reinforcement Learning (RL) em ambientes de milhões de agentes, o Alibaba dotou esses pequenos modelos de “julgamento alinhado ao humano”, permitindo-lhes lidar com objetivos de várias etapas, como organizar uma área de trabalho ou fazer engenharia reversa de imagens de jogo em código. Seja um modelo 0,8B rodando em um smartphone ou um modelo 9B alimentando um terminal de codificação, a série Qwen3.5 está efetivamente democratizando a “era agentic”.

A mudança da série Qwen3.5 de “chatbits” para “agentes multimodais nativos” transforma a forma como as empresas podem distribuir inteligência. Ao mover o raciocínio sofisticado para a “borda” – dispositivos individuais e servidores locais – as organizações podem automatizar tarefas que antes exigiam APIs de nuvem caras ou processamento de alta latência.

Aplicações e considerações empresariais estratégicas

Os modelos 0,8B a 9B foram reprojetados para serem eficientes, utilizando uma arquitetura híbrida que ativa apenas as partes necessárias da rede para cada tarefa.

-

Automação visual do fluxo de trabalho: Usando “fundação em nível de pixel”, esses modelos podem navegar em interfaces de usuário de desktop ou móveis, preencher formulários e organizar arquivos com base em instruções de linguagem natural.

-

Análise complexa de documentos: Com pontuações superiores a 90% em benchmarks de compreensão de documentos, eles podem substituir pipelines separados de OCR e análise de layout para extrair dados estruturados de diversos formulários e gráficos.

-

Codificação e refatoração autônoma: As empresas podem alimentar repositórios inteiros (até 400.000 linhas de código) na janela de contexto de 1 milhão para refatorações prontas para produção ou depuração automatizada.

-

Análise de borda em tempo real: Os modelos 0,8B e 2B são projetados para dispositivos móveis, permitindo resumo de vídeo offline (até 60 segundos a 8 FPS) e raciocínio espacial sem sobrecarregar a vida útil da bateria.

A tabela abaixo descreve quais funções empresariais podem ganhar mais com a implantação local de modelos pequenos.

|

Função |

Benefício Primário |

Caso de uso principal |

|

Engenharia de Software |

Inteligência de código local |

Refatoração em todo o repositório e codificação agente baseada em terminal. |

|

Operações e TI |

Automação segura |

Automatizando configurações do sistema em várias etapas e tarefas de gerenciamento de arquivos localmente. |

|

Produto e experiência do usuário |

Interação de borda |

Integração de raciocínio multimodal nativo diretamente em aplicativos móveis/desktop. |

|

Dados e análises |

Extração Eficiente |

OCR de alta fidelidade e extração estruturada de dados de relatórios visuais complexos. |

Embora esses modelos sejam altamente capazes, sua pequena escala e sua natureza “agente” introduzem “sinais” operacionais específicos que as equipes devem monitorar.

-

A Cascata da Alucinação: Em fluxos de trabalho “agentes” de várias etapas, um pequeno erro em uma etapa inicial pode levar a uma “cascata” de falhas em que o agente segue um plano incorreto ou sem sentido.

-

Depuração vs. Codificação Greenfield: Embora esses modelos sejam excelentes na escrita de novos códigos “greenfield”, eles podem ter dificuldades para depurar ou modificar sistemas legados complexos e existentes.

-

Demandas de memória e VRAM: Mesmo modelos “pequenos” (como o 9B) requerem VRAM significativo para inferência de alto rendimento; a “pegada de memória” permanece alta porque a contagem total de parâmetros ainda ocupa espaço da GPU.

-

Residência regulatória e de dados: O uso de modelos de um provedor baseado na China pode levantar questões de residência de dados em certas jurisdições, embora a versão aberta do Apache 2.0 permita hospedagem em nuvens locais “soberanas”.

As empresas devem priorizar tarefas “verificáveis” – como codificação, matemática ou acompanhamento de instruções – onde o resultado pode ser verificado automaticamente em relação a regras predefinidas para evitar “hacking de recompensa” ou falhas silenciosas.