A maioria das pessoas não aprecia a profunda ameaça que a IA representará em breve para agência humana. Um refrão comum é que “IA é apenas uma ferramenta” e como qualquer ferramenta, os seus benefícios e perigos dependem da forma como as pessoas a utilizam. Este é o pensamento da velha escola. A IA está em transição de ferramentas que usamos para próteses que usamos. Esse criará novas ameaças significativas simplesmente não estamos preparados.

Não, não estou falando de implantes cerebrais assustadores. Essas próteses alimentadas por IA serão produtos convencionais que compramos na Amazon ou na Apple Store e comercializados com nomes amigáveis como “assistentes”, “treinadores”, “copilotos” e “tutores”. Eles proporcionarão um valor real em nossas vidas – tanto que nos sentiremos em desvantagem se outras pessoas os usarem e nós não. Isto criará uma pressão rápida para a adoção em massa.

Os dispositivos protéticos a que me refiro são “Wearables alimentados por IA“, como óculos inteligentes, pingentes, alfinetes e fones de ouvido. Sua IA vestível verá o que você vê e ouvirá o que ouve, ao mesmo tempo em que rastreia onde você está, o que está fazendo, com quem está e o que está tentando alcançar. Então, sem que você precise dizer uma palavra, esses recursos mentais irão sussurrar conselhos em seus ouvidos ou flash de orientação diante de seus olhos.

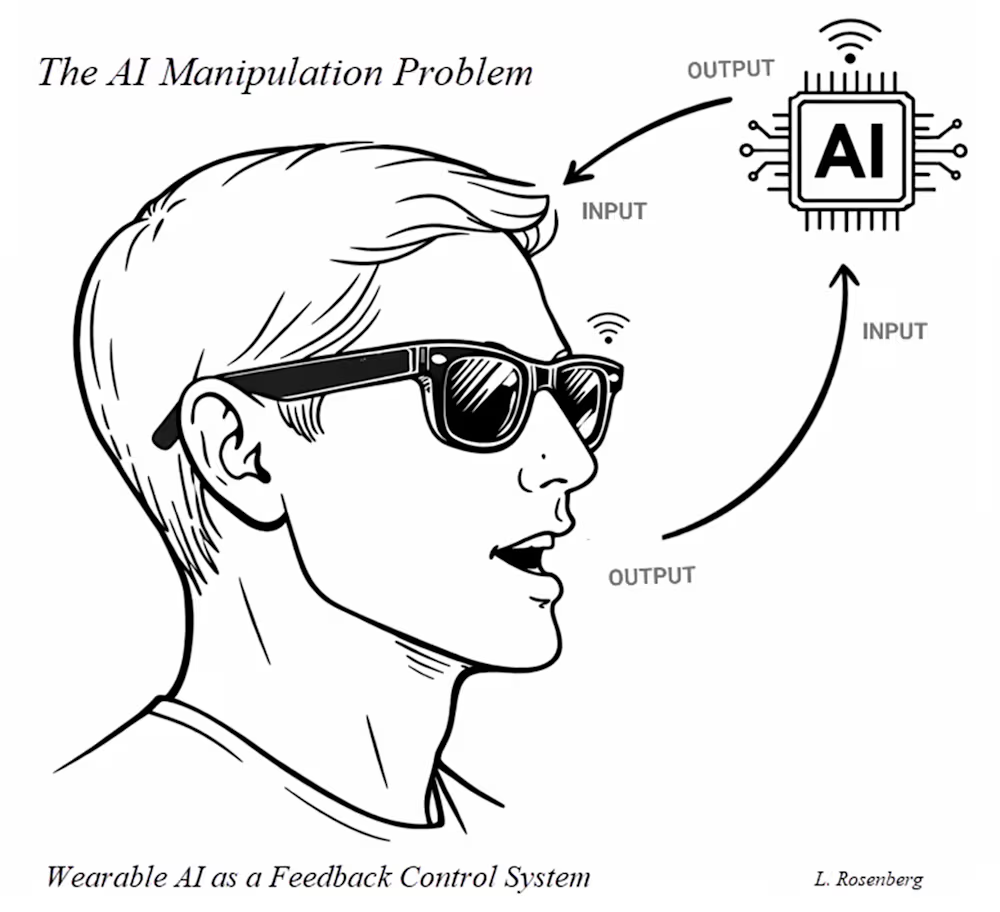

A diferença entre uma ferramenta e uma prótese pode parecer sutil, mas a implicações para a agência humana são profundos. Isto é melhor compreendido através de uma análise simples de entradas e saídas. Uma ferramenta recebe informações humanas e gera resultados amplificados. Uma ferramenta pode nos tornar mais fortes, mais rápidos ou nos permitir voar. Uma prótese mental, por outro lado, forma um ciclo de feedback em torno do ser humano, aceitando informações do usuário (rastreando suas ações e envolvendo-os em conversas) e gerando resultados que podem influenciar imediatamente o pensamento do usuário.

Esse ciclo de feedback muda tudo. Isso ocorre porque os dispositivos de IA usados no corpo serão capazes de monitorar nossos comportamentos e emoções e poderão usar esses dados para fale-nos acreditar em coisas que não são verdadeiras, comprar coisas que não precisamos ou adotar pontos de vista que de outra forma perceberíamos que não são do nosso interesse. Isso é chamado o problema de manipulação de IAe não estamos preparados para os riscos. Esta é uma questão urgente porque as grandes tecnologias estão a correr para lançar estes produtos no mercado.

Por que os ciclos de feedback são tão perigosos?

No mundo de hoje, todos os dispositivos de computação são usados para exercer influência direcionada em nome de patrocinadores pagantes. Os produtos vestíveis de IA provavelmente continuarão essa tendência. O problema é que esses dispositivos poderiam facilmente receber um “objetivo de influência” e ter a tarefa de otimizar seu impacto no usuário, adaptando suas táticas de conversação para superar qualquer resistência que detecte. Isso transforma o conceito de influência direcionada desde tiros de mídia social até mísseis guiados por calor que navegam habilmente por suas defesas. E, no entanto, os decisores políticos não apreciam este risco.

Infelizmente, a maioria dos reguladores ainda vê o perigo da IA em termos da sua capacidade de gerar rapidamente formas tradicionais de influência (deepfakes, notícias falsas, propaganda). É claro que estas são ameaças significativas, mas não são tão perigosas quanto as influência interativa e adaptativa que em breve poderá ser amplamente implantado por meio de agentes de conversação, especialmente quando esses agentes de IA viajam conosco durante nossas vidas dentro de dispositivos vestíveis.

Isso virá em breve

Meta, Google e Apple estão correndo para lançar produtos de IA vestíveis o mais rápido possível. Para proteger o público, os decisores políticos precisam de abandonar o seu enquadramento de “utilização de ferramentas” ao regulamentar os dispositivos de IA. Isso é difícil porque a metáfora do uso de ferramentas remonta a 35 anos, quando Steve Jobs descreveu o PC como um “bicicleta da mente.” A bicicleta é uma ferramenta poderosa que mantém o ciclista firmemente no controle. A IA vestível vai virar essa metáfora de cabeça para baixo, fazendo-nos pensar quem está dirigindo a bicicleta – o humano, os agentes de IA sussurrando nos ouvidos dos humanos ou as corporações que implantaram os agentes? Acredito que será uma mistura perigosa dos três.

Além disso, os usuários provavelmente confiarão no Vozes de IA em suas cabeças mais do que deveriam. Isto porque estes agentes de IA irão fornecer-nos conselhos e informações úteis ao longo da nossa vida diária – educando-nos, lembrando-nos, treinando-nos, informando-nos. O problema é que podemos não ser capazes de distinguir quando o agente de IA mudou o seu objectivo de nos ajudar para nos influenciar. Para apreciar a diferença, você pode assistir ao premiado curta-metragem Privacidade perdida (2023) sobre os perigos dos dispositivos vestíveis alimentados por IA. Isto é especialmente verdadeiro quando os dispositivos incluem recursos invasivos, como reconhecimento facial (que Meta está supostamente adicionando para seus óculos).

O que podemos fazer para proteger o público?

Em primeiro lugar, os decisores políticos precisam de perceber que a IA conversacional permite uma forma inteiramente nova de mídia que é interativo, adaptativo, individualizado e cada vez mais consciente do contexto. Esta nova forma de mídia funcionará como “influência ativa”, porque poderá ajustar suas táticas em tempo real para superar a resistência do usuário. Quando implantados em dispositivos vestíveis, esses sistemas de IA poderiam ser projetados para manipular nossas ações, influenciar nossas opiniões e nossas crenças – e fazer tudo isso através de diálogo aparentemente casual. Pior ainda, esses agentes aprenderão com o tempo quais táticas de conversação funcionam melhor para cada um de nós em nível pessoal.

O fato é que os agentes conversacionais não deve ser permitido formar malhas de controle em torno dos usuários. Se isto não for regulamentado, a IA será capaz de nos influenciar com uma capacidade de persuasão sobre-humana. Além disso, os agentes de IA devem ser obrigado a informar os usuários sempre que fizerem a transição para expressar conteúdo promocional em nome de terceiros. Sem essas proteções, os agentes de IA provavelmente se tornarão tão persuasivos que farão com que as atuais técnicas de influência direcionada pareçam estranhas.

Louis Rosenberg é um pioneiro da realidade aumentada e um pesquisador de IA de longa data. Ele obteve seu doutorado em Stanford, foi professor na California State University e é autor de vários livros sobre os perigos da IA, incluindo Arrival Mind e Our Next Reality.

Bem-vindo à comunidade VentureBeat!

Nosso programa de guest posts é onde especialistas técnicos compartilham insights e fornecem análises profundas, neutras e não adquiridas, sobre IA, infraestrutura de dados, segurança cibernética e outras tecnologias de ponta que moldam o futuro das empresas.

Leia mais do nosso programa de guest post – e confira nosso diretrizes se você estiver interessado em contribuir com um artigo de sua autoria!