Ao construir aplicativos LLM, as empresas muitas vezes precisam criar prompts de sistema muito longos para ajustar o comportamento do modelo para seus aplicativos. Esses prompts contêm conhecimento da empresa, preferências e instruções específicas da aplicação. Em escala empresarial, esses contextos podem levar a latência de inferência além dos limites aceitáveis e aumentar significativamente os custos por consulta.

Destilação de contexto sob política (OPCD), uma nova estrutura de treinamento proposta por pesquisadores da Microsoft, ajuda a incorporar o conhecimento e as preferências dos aplicativos diretamente em um modelo. O OPCD utiliza as próprias respostas do modelo durante o treinamento, o que evita algumas das armadilhas de outras técnicas de treinamento. Isto melhora as capacidades dos modelos para aplicações personalizadas, preservando ao mesmo tempo as suas capacidades gerais.

Por que longos prompts do sistema se tornam um risco

Aprendizagem contextual permite que os desenvolvedores atualizem o comportamento de um modelo no momento da inferência sem modificar seus parâmetros subjacentes. A atualização de parâmetros normalmente é um processo lento e caro. No entanto, o conhecimento no contexto é transitório. Esse conhecimento não conduz a diferentes conversas com o modelo, o que significa que você deve alimentar o modelo sempre com o mesmo conjunto enorme de instruções ou documentos. Para um aplicativo empresarial, isso pode significar colar repetidamente políticas da empresa, tickets de clientes ou manuais técnicos densos no prompt. Isso eventualmente desacelera o modelo, aumenta os custos e pode confundir o sistema.

“As empresas costumam usar longos prompts de sistema para impor restrições de segurança (por exemplo, detecção de discurso de ódio) ou para fornecer conhecimentos específicos de domínio (por exemplo, conhecimento médico)”, disse Tianzhu Ye, coautor do artigo e pesquisador da Microsoft Research Asia, em comentários fornecidos à VentureBeat. “No entanto, prompts longos aumentam significativamente a sobrecarga computacional e a latência no momento da inferência.”

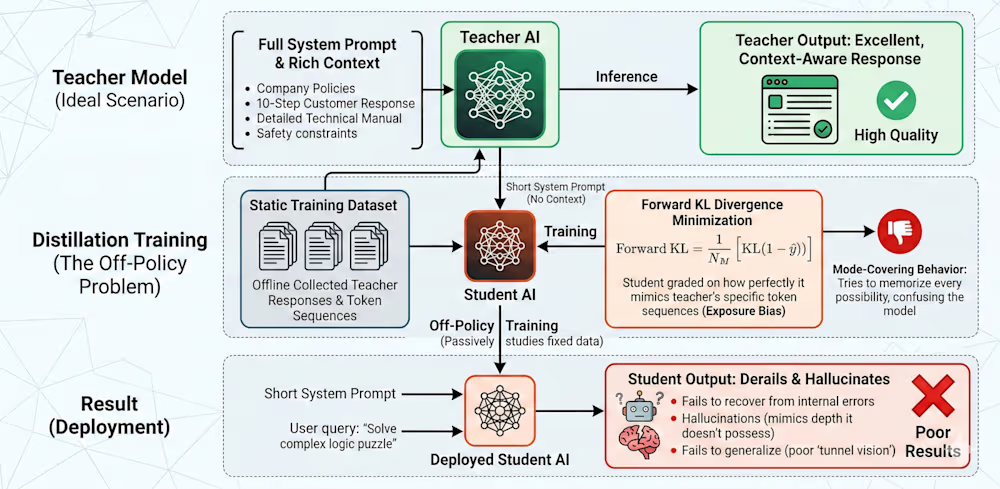

A ideia principal por trás da destilação de contexto é treinar um modelo para internalizar as informações que você insere repetidamente no contexto. Como outros técnicas de destilaçãosegue um paradigma professor-aluno. O professor é um modelo de IA que recebe solicitações massivas e detalhadas. Por possuir todas as instruções e documentos de referência, gera respostas altamente personalizadas. O aluno é um modelo em formação que só vê a questão principal e não tem acesso ao contexto completo. Seu objetivo é simplesmente observar as respostas do professor e aprender a imitar seu comportamento.

Através deste processo de treinamento, o modelo do aluno comprime efetivamente as instruções complexas do prompt do professor diretamente em seus parâmetros. Para uma empresa, o valor principal acontece no momento da inferência. Como o modelo de aluno internalizou o contexto, você pode implantá-lo em seu aplicativo sem precisar colar instruções extensas novamente. Isso torna o modelo significativamente mais rápido e com muito menos sobrecarga computacional.

No entanto, a destilação de contexto clássica depende de um método de treinamento falho chamado “treinamento fora da política”, em que o modelo é treinado em conjuntos de dados fixos que foram coletados antes do processo de treinamento. Isto é problemático de várias maneiras. Durante o treinamento, o aluno é exposto apenas a dados verdadeiros e respostas geradas pelo professor, criando o que Ye chama de “viés de exposição”. Na produção, o modelo deve criar suas próprias sequências de tokens para chegar a essas respostas. Como nunca praticou tomar suas próprias decisões ou se recuperar de seus próprios erros durante o treinamento, pode facilmente descarrilar quando opera de forma independente. É como mostrar a um aluno vídeos de um motorista profissional e esperar que ele aprenda a dirigir sem tentativa e erro.

Outro problema é o “avançar Divergência de Kullback-Leibler (KL)“medida de minimização usada para treinar o modelo. Nesse método, o modelo é classificado de acordo com a semelhança de suas respostas com as do professor, o que incentiva o comportamento de “cobertura de modo”, diz Ye. O modelo do aluno geralmente é menor ou carece do contexto rico que o professor tinha, o que significa que simplesmente não tem a capacidade de replicar perfeitamente o raciocínio complexo do professor. Como o aluno é forçado a tentar cobrir todas essas possibilidades de qualquer maneira, suas suposições subjacentes tornam-se excessivamente amplas e desfocadas.

Em aplicações do mundo real, isso pode resultar em alucinações, onde a IA fica confusa e inventa coisas com confiança porque está tentando imitar uma profundidade de conhecimento que na verdade não possui. Isso também significa que o modelo não pode generalizar bem para novas tarefas.

Como o OPCD resolve o problema professor-aluno

Para corrigir os problemas críticos da antiga dinâmica professor-aluno, os pesquisadores da Microsoft introduziram a Destilação de Contexto On-Policy (OPCD). A mudança mais importante no OPCD é que o modelo do estudante aprende com as suas próprias trajetórias de geração, em oposição a um conjunto de dados estáticos (razão pela qual é denominado “on-policy”). Em vez de estudar passivamente um conjunto de dados dos resultados perfeitos do professor, o aluno recebe uma tarefa sem ver o enorme prompt de instrução e tem que gerar uma resposta inteiramente por conta própria.

À medida que o aluno gera sua resposta, o professor atua como um instrutor ao vivo. O professor tem acesso ao prompt completo e personalizado e avalia o resultado do aluno. A cada passo da geração do aluno, o sistema compara a distribuição de tokens do aluno com o que o professor consciente do contexto faria.

O OPCD usa “divergência KL reversa” para avaliar o aluno. “Ao minimizar a divergência reversa de KL, promove o comportamento de ‘busca de modo’. Ele se concentra em regiões de alta probabilidade da distribuição do aluno”, disse Ye. “Ele suprime tokens que o aluno considera improváveis, mesmo que a crença do professor lhes atribua alta probabilidade. Esse alinhamento ajuda o aluno a corrigir seus próprios erros e a evitar as distribuições amplas e alucinatórias da destilação padrão.”

Como o modelo do aluno pratica ativamente a tomada de decisões e aprende a corrigir os próprios erros durante o treinamento, ele se comporta de maneira mais confiável quando implantado em um aplicativo ativo. Ele incorpora com sucesso regras de negócios complexas, restrições de segurança ou conhecimento especializado diretamente em sua memória permanente.

O que o OPCD oferece: os resultados do benchmark

Os pesquisadores testaram o OPCD em duas áreas principais: destilação de conhecimento experimental e destilação imediata do sistema. Para a destilação do conhecimento experiencial, os investigadores queriam ver se um LLM poderia aprender com os seus próprios sucessos passados e adoptar permanentemente essas lições. Eles testaram isso em modelos de vários tamanhos, usando problemas de raciocínio matemático.

Primeiro, o modelo resolveu problemas e foi solicitado a escrever regras gerais que aprendeu com os seus sucessos. Depois, usando o OPCD, eles inseriram essas lições escritas diretamente nos parâmetros do modelo. Os resultados mostraram que os modelos melhoraram dramaticamente sem precisar mais da experiência aprendida colada em seus prompts. Em problemas matemáticos complexos, um modelo de 8 bilhões de parâmetros melhorou de uma linha de base de 75,0% para 80,9%. Por exemplo, no jogo de navegação Frozen Lake, um pequeno modelo de parâmetros de 1,7 bilhão teve inicialmente uma taxa de sucesso de 6,3%. Após o OPCD incorporar a experiência aprendida, sua precisão saltou para 38,3%.

O segundo conjunto de experimentos ocorreu em longos prompts do sistema. As empresas costumam usar avisos de sistema massivos para impor diretrizes comportamentais rígidas, como manter um tom profissional, garantir a precisão médica ou filtrar linguagem tóxica. Os pesquisadores testaram se o OPCD poderia incorporar permanentemente essas regras comportamentais densas nos modelos, para que não precisassem ser enviadas com cada consulta do usuário. As suas experiências mostram que o OPCD internalizou com sucesso estas regras complexas e melhorou enormemente o desempenho. Ao testar um modelo Llama de 3 bilhões de parâmetros na classificação de segurança e toxicidade, o modelo básico obteve 30,7%. Depois de usar o OPCD para internalizar o alerta de segurança, sua precisão aumentou para 83,1%. No atendimento a questões médicas, o mesmo modelo melhorou de 59,4% para 76,3%.

Um dos principais desafios dos modelos de ajuste fino é esquecimento catastróficoonde o modelo fica muito focado na tarefa de ajuste fino e pior nas tarefas gerais. Os pesquisadores acompanharam o desempenho fora de distribuição para testar essa visão de túnel. Quando destilaram regras rigorosas de segurança num modelo, testaram imediatamente a sua capacidade de responder a questões médicas não relacionadas. O OPCD manteve com sucesso o conhecimento médico geral do modelo, superando os antigos métodos fora da política em aproximadamente 4 pontos percentuais. Especializou-se sem perder a sua inteligência mais ampla.

Onde o OPCD se encaixa – e onde não cabe

Embora o OPCD seja uma ferramenta poderosa para internalizar conhecimento estático e regras complexas, ele não substitui todos os métodos de contexto externo. “O RAG é melhor quando as informações necessárias são altamente dinâmicas ou envolvem um banco de dados externo enorme e frequentemente atualizado que não pode ser compactado em pesos de modelo”, disse Ye.

Para as equipes empresariais que avaliam seus pipelines, a adoção do OPCD não exige a revisão dos sistemas existentes ou o investimento em hardware especializado. “O OPCD pode ser integrado aos fluxos de trabalho existentes com muito pouco atrito”, disse Ye. “Qualquer equipe que já execute RLVR padrão [Reinforcement Learning from Verifiable Rewards] pipelines podem adotar o OPCD sem grandes mudanças arquitetônicas.”

Na prática, o modelo do aluno atua como o modelo de política que realiza as implementações, enquanto o modelo do professor congelado serve como referência, fornecendo logits. Os requisitos de hardware são altamente acessíveis. De acordo com Ye, as equipes empresariais podem reproduzir os experimentos dos pesquisadores usando cerca de oito GPUs A100.

Os requisitos de dados são igualmente leves. Para destilação de conhecimento experimental, os desenvolvedores precisam apenas de cerca de 30 exemplos iniciais para gerar traços de solução. Como a técnica é aplicada a ambientes anteriormente não otimizados, mesmo uma pequena quantidade de dados produz a maior parte da melhoria de desempenho. Para destilação de prompt do sistema, os prompts otimizados existentes e os conjuntos de dados de tarefas padrão são suficientes.

Os pesquisadores construíram sua própria implementação em verluma base de código RLVR de código aberto, provando que a técnica se encaixa perfeitamente nas estruturas convencionais de aprendizagem por reforço. Eles planejam lançar sua implementação como código aberto após revisões internas.

O modelo de autoaperfeiçoamento: o que vem a seguir

Olhando para o futuro, o OPCD abre caminho para modelos genuinamente auto-aperfeiçoados que se adaptam continuamente a ambientes empresariais personalizados. Uma vez implantado, um modelo pode extrair lições de interações do mundo real e usar o OPCD para internalizar progressivamente essas características sem exigir supervisão manual ou anotação de dados dos instrutores de modelos.

“Isso representa uma mudança fundamental de paradigma na melhoria do modelo: as principais melhorias no modelo passariam do tempo de treinamento para o tempo de teste”, disse Ye. “Usar o modelo – e permitir que ele acumule experiência – se tornaria o principal impulsionador de seu avanço.”